難道神經網絡不用學權重也能完成各種任務?難道我們以為 CNN 學習到的圖像特征只是我們以為?神經網絡只不過是函數的排列組合,沒有其它意義?從這篇論文來看,這些答案似乎都是肯定的。

昨天,谷歌大腦 David Ha 等人一篇名為《Weight Agnostic Neural Networks》的論文引爆了機器學習圈。其「顛覆性」的理論讓人驚呼:「到頭來我們對神經網絡一無所知?」

Reddit 上有一些研究者認為,《Weight Agnostic Neural Networks》這篇論文更有趣的意義在于,它也宣告了深度學習分層編碼特征這一解釋壽終正寢。

通常情況下,權重被認為會被訓練成 MNIST 中邊角、圓弧這類直觀特征,而如果論文中的算法可以處理 MNIST,那么它們就不是特征,而是函數序列/組合。對于 AI 可解釋性來說,這可能是一個打擊。

很容易理解,神經網絡架構并非「生而平等」,對于特定任務一些網絡架構的性能顯著優于其他模型。但是相比架構而言,神經網絡權重參數的重要性到底有多少?

來自德國波恩-萊茵-錫格應用技術大學和谷歌大腦的一項新研究提出了一種神經網絡架構搜索方法,這些網絡可以在不進行顯式權重訓練的情況下執行各種任務。

為了評估這些網絡,研究者使用從統一隨機分布中采樣的單個共享權重參數來連接網絡層,并評估期望性能。結果顯示,該方法可以找到少量神經網絡架構,這些架構可以在沒有權重訓練的情況下執行多個強化學習任務,或 MNIST 等監督學習任務。

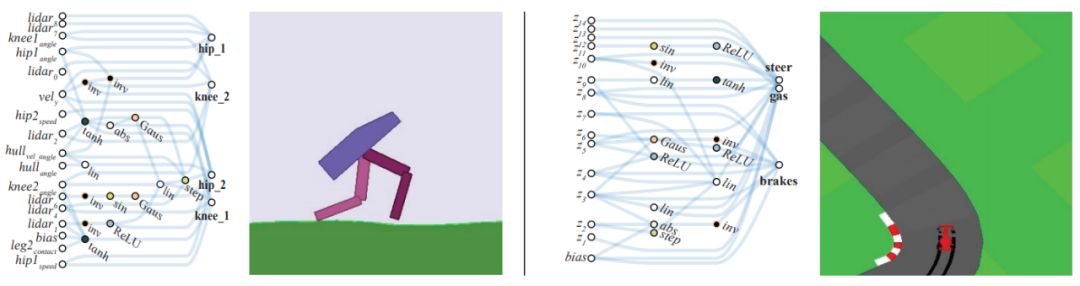

如下是兩個不用學習權重的神經網絡示例,分別是二足行走智能體(上)和賽車(下):

為什么神經網絡不用學習權重

在生物學中,早成性物種是指那些天生就有一些能力的幼生體。很多證據表明蜥蜴和蛇等動物天生就懂得逃避捕食者,鴨子在孵化后也能自己學會游泳和進食。

相比之下,我們在訓練智能體執行任務時,會選擇一個典型的神經網絡框架,并相信它有潛力為這個任務編碼特定的策略。注意這里只是「有潛力」,我們還要學習權重參數,才能將這種潛力變化為能力。

受到自然界早成行為及先天能力的啟發,在這項工作中,研究者構建了一個能「自然」執行給定任務的神經網絡。也就是說,找到一個先天的神經網絡架構,然后只需要隨機初始化的權重就能執行任務。研究者表示,這種不用學習參數的神經網絡架構在強化學習與監督學習都有很好的表現。

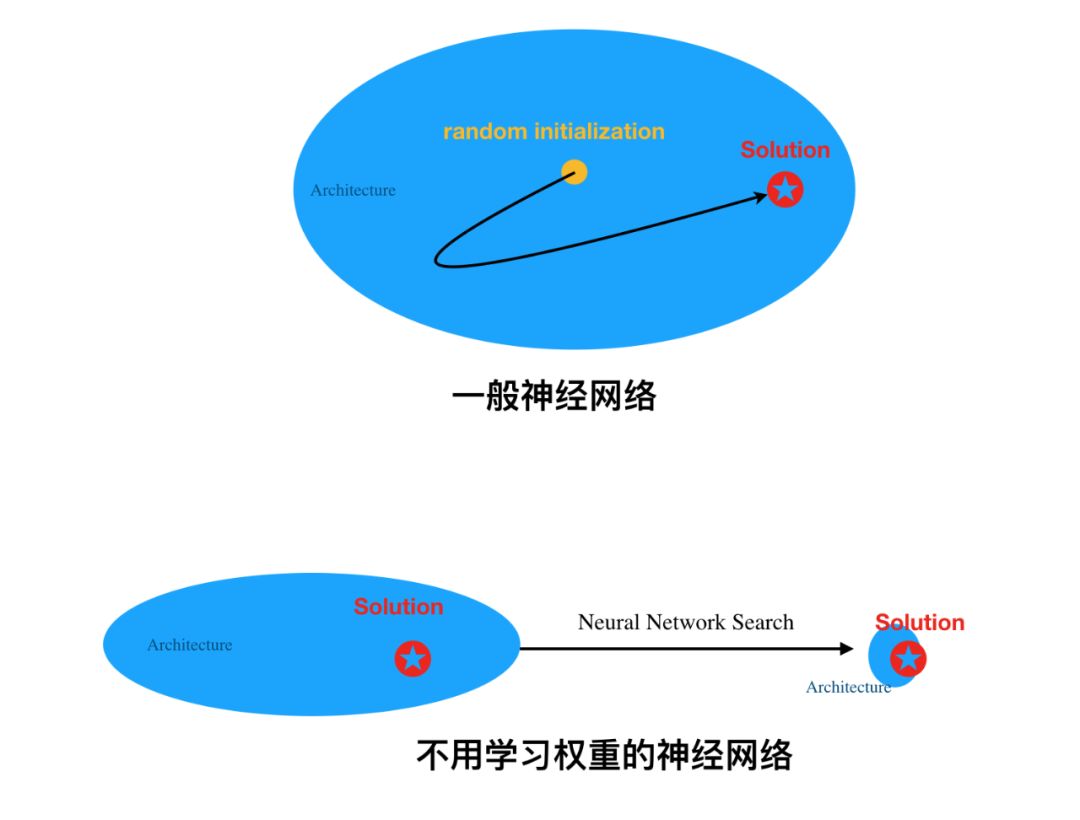

其實在我們的理解中,如果我們想象神經網絡架構提供的就是一個圈,那么常規學習權重就是找到一個最優「點」(或最優參數解)。但是對于不用學習權重的神經網絡,它就相當于引入了一個非常強的歸納偏置,以至于,整個架構偏置到能直接解決某個問題。

如上是我們對兩種網絡的直觀理解。一般神經網絡在架構內隨機初始化權重,再學習權重以找到最優解,這樣的模型就能完成特定任務。一般只要架構足夠「大」,那么它很可能包含最優解,梯度下降也就能大致找到它了。

但是對于不用學習權重的神經網絡,它相當于不停地特化架構,或者說降低模型方差。這樣,當架構越來越小而只包含最優解時,隨機化的權重也就能解決實際問題了。當然,如研究者那樣從小架構到大架構搜索也是可行的,只要架構能正好將最優解包圍住就行了。

以前就有懶得學習的神經網絡

幾十年的神經網絡研究為不同的任務提供了具有強歸納偏置的構造塊。比如卷積神經網絡就尤其適合處理圖像。

Ulyanov 等人 [109] 展示了隨機初始化的 CNN 可在標準逆問題(如去噪、超分辨率和圖像修復)中作為手工先驗知識(handcrafted prior)使用,且性能優越。

Schmidhuber 等人 [96] 展示了使用習得線性輸入層的隨機初始化 LSTM 可以預測時序,而傳統 RNN 不行。近期在自注意力 [113] 和膠囊網絡 [93] 方面的研究拓寬了創建適用于多個任務的架構的構造塊范圍。

受隨機初始化 CNN 和 LSTM 的啟發,該研究旨在搜索權重無關的神經網絡,即這些具備強歸納偏置的網絡可以使用隨機權重執行不同任務。

核心思想

為了尋找具備強歸納偏置的神經網絡架構,研究者提出通過降低權重重要性的方式來搜索架構。具體步驟為:1)為每一個網絡連接提供單一的共享權重參數;2)在較大的權重參數值范圍內評估網絡。

該研究沒有采用優化固定網絡權重的方式,而是優化在大范圍權重值上都有良好性能的架構。研究者證明,該方法可生成使用隨機權重參數執行不同連續控制任務的網絡。

圖 1:權重無關神經網絡示例:二足行走智能體(左)、賽車(右)。研究者通過降低權重重要性的方式搜索架構。網絡使用單一的共享權重值。所有架構在大范圍權重值上進行性能優化后,仍然能夠在沒有權重訓練的情況下執行不同任務。

權重無關的神經網絡搜索

創建編碼解的網絡架構與神經架構搜索(NAS)解決的問題有著本質上的區別。NAS 技術的目標是生成訓練完成后能夠超越人類手工設計的架構。從來沒有人聲稱該解是該網絡架構所固有的。

為了生成自身能夠編碼解的架構,權重的重要性必須最小化。在評估網絡性能時,研究者沒有選擇使用最優權重值的網絡,而從隨機分布中抽取權重值。用權重采樣取代權重訓練可以確保性能只與網絡拓撲結構有關。

然而,由于維度很高,除了最簡單的網絡外,權重空間的可靠采樣在所有網絡上都是不可行的。盡管維度問題阻礙了研究者對高維權重空間進行高效采樣,但通過在所有權重上執行權重共享,權重值的數量減少到 1。

系統采樣單個權值非常簡單、高效,可以讓我們進行幾次試驗就能近似網絡性能。然后可以利用這一近似來搜索更好的架構。

主要流程

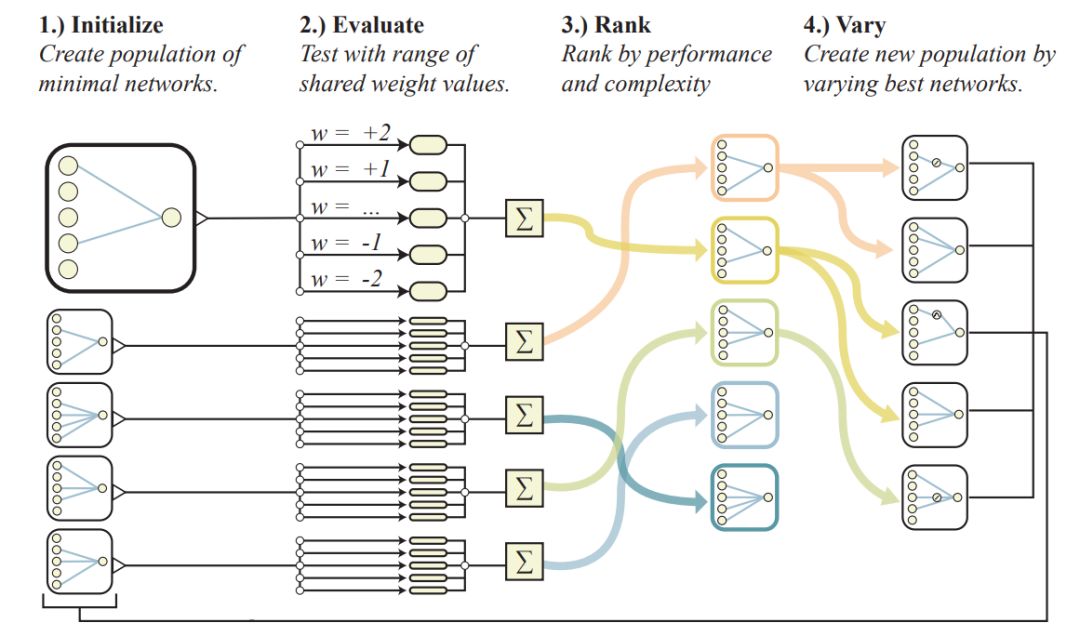

搜索權重無關的神經網絡(WANN)的流程如下:

創建最少神經網絡拓撲結構的初始群組;

在多個 rollout 上對每個網絡進行評估,每個 rollout 分配一個不同的共享權重值;

根據網絡的性能和復雜度對其進行排序;

通過改變排名最高的網絡拓撲結構創建新的群組,這些拓撲結構是通過錦標賽選擇法(tournament selection)根據概率選擇的。

接下來,算法從 (2) 開始重復,生成復雜度遞增的權重無關拓撲結構,其性能優于之前的幾代。

圖 2:與權重無關的神經網絡搜索圖示。

通過每次 rollout 時采樣單個共享權重,與權重無關的神經網絡搜索在避免權重訓練的同時,探索神經網絡拓撲結構的空間。研究者基于多次 rollout 評估網絡,在每次 rollout 時,為單個共享權重指定相應的值,并記錄實驗期間的累積獎勵。

之后,根據網絡的性能和復雜度對網絡群組進行排序。然后,根據概率選出排名最高的網絡以生成新的群組,排名最高的網絡是會隨機變化的。之后重復這一過程。

最最核心的拓撲搜索

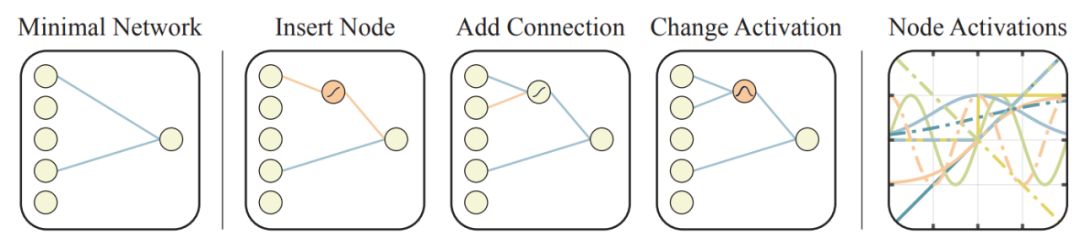

用于搜索神經網絡拓撲的算子受到神經進化算法 NEAT 的啟發。不過 NEAT 中的拓撲和權重值是同時進行優化的,而本研究無視權重,僅使用拓撲搜索算子。

最初的搜索空間包括多個稀疏連接網絡、沒有隱藏節點的網絡,以及輸入和輸出層之間僅有少量可能連接的網絡。使用 insert node、add connection、change activation 這三個算子中的其中一個修改已有網絡,從而創建新網絡。新節點的激活函數是隨機分配的。

圖 3:搜索網絡拓撲空間的算子。

鑒于網絡的前饋本質,在之前不連接的節點之間添加新連接。當隱藏節點的激活函數被改變后,激活函數進入隨機分配模式。激活函數包括常見函數(如線性激活函數、sigmoid、ReLU)和不那么常見的(如 Gaussian、sinusoid、step),它們編碼輸入和輸出之間的多種關系。

實驗結果

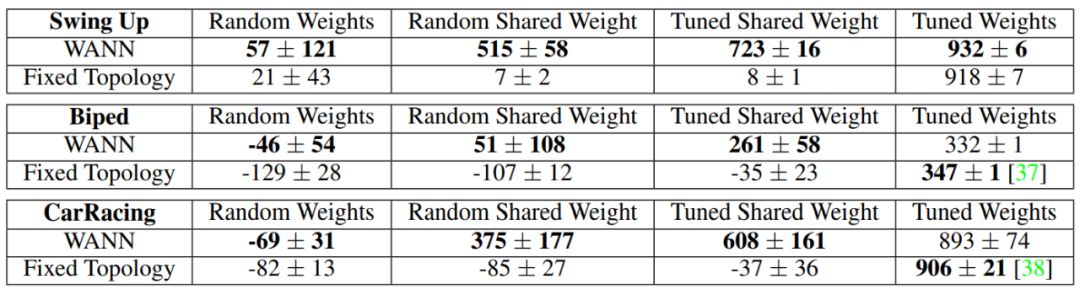

該研究在三個連續控制任務上評估權重無關神經網絡(WANN):CartPoleSwingUp、BipedalWalker-v2 和 CarRacing-v0。研究者基于之前研究常用的標準前饋網絡策略創建權重無關網絡架構,從中選取最好的 WANN 架構進行平均性能對比(100 次試驗)。

表 1:隨機采樣網絡和使用權重訓練的網絡在連續控制任務上的性能。

傳統的固定拓撲網絡僅在大量調參后才能生成有用的行為,而 WANN 使用隨機共享權重都可以執行任務。

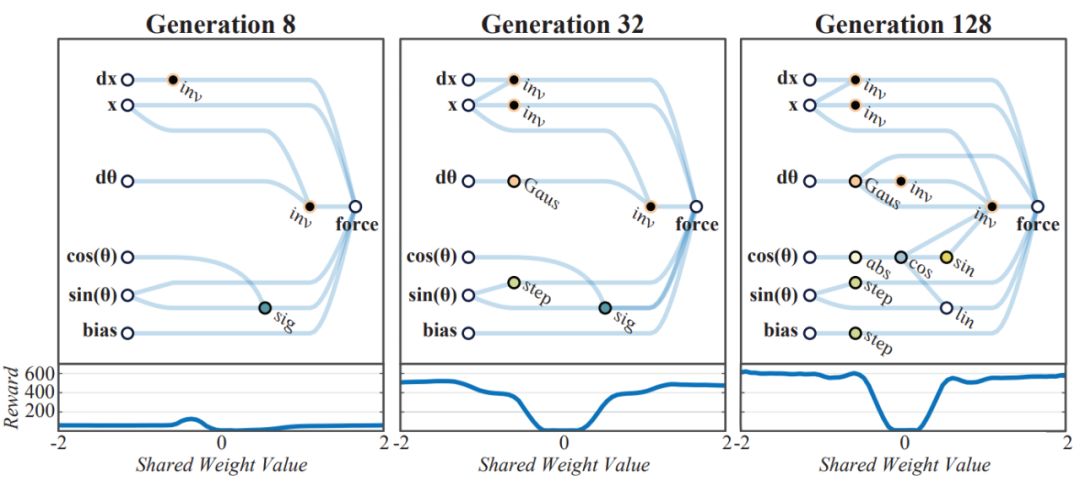

由于 WANN 很小,很容易解釋,因此我們可以查看以下網絡圖示,了解其工作原理。

圖 4:權重無關拓撲隨著時間的變化。Generation 128:添加復雜度,以改進小車的平衡動作。

模型最終在 BipedalWalker-v2 任務上獲得的最好效果。

模型最終在 CarRacing-v0 任務上獲得的最好效果。

有監督分類問題又怎樣

WANN 方法在強化學習任務上取得的成果讓我們開始思考,它還可以應用到哪些問題?WANN 能夠編碼輸入之間的關系,非常適合強化學習任務:低維輸入加上內部狀態和環境交互,使反應型和自適應控制器得以發現。

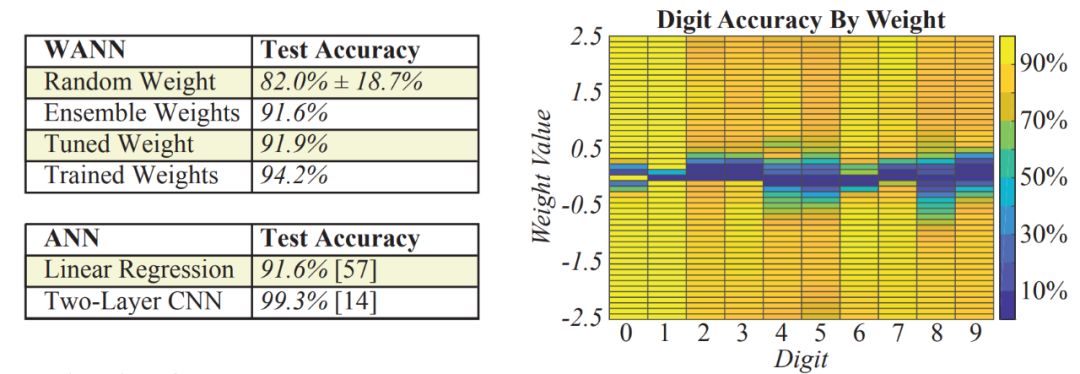

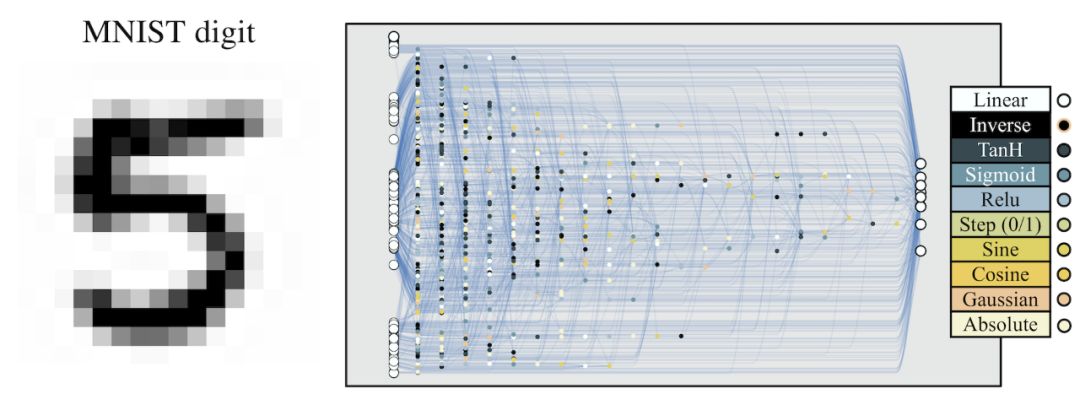

然而,分類問題沒那么模糊,它界限分明,對就是對,錯就是錯。作為概念證明,研究者調查了 WANN 在 MNIST 數據集上的表現。

即使是在高維分類任務中,WANN 方法依然表現非常好(如圖 5 左所示)。雖然局限于單個權重值,WANN 方法能夠分類 MNIST 數字,且性能堪比具備數千個權重的單層神經網絡(權重通過梯度下降進行訓練)。創建的架構依然保持權重訓練所需的靈活性,從而進一步提升準確率。

圖 5:MNIST 數據集上的分類準確率。

上圖左:以多個權重值作為集成進行實例化的 WANN 比隨機權重采樣的網絡性能好得多,且性能與具有數千個權重的線性分類器相同。上圖右:在所有數字上具有更高準確率的單個權重值不存在。WANN 可被實例化為多個不同網絡,它們具有創建集成的可能性。

MNIST 分類網絡進化為可以使用隨機權重。

-

控制器

+關注

關注

112文章

16214瀏覽量

177479 -

神經網絡

+關注

關注

42文章

4765瀏覽量

100566 -

機器學習

+關注

關注

66文章

8382瀏覽量

132444

原文標題:真正的神經網絡,敢于不學習權重

文章出處:【微信號:zenRRan,微信公眾號:深度學習自然語言處理】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

真正的神經網絡到底要不要學習權重

真正的神經網絡到底要不要學習權重

評論