傳感器在我們的世界經歷了快速的推廣,事實上,傳感器現在已經非常普遍,以至于我們每個人日常所使用的手機里都有好幾種不同類型的傳感器。這些傳感器有的能檢測壓力、溫度、加速度和重力的簡單變化,同樣也有更為高級的傳感器,例如GPS、RADAR、LIDAR和圖像傳感器。

傳感器融合是指從幾種不同的傳感器中提取數據,以生成靠單個傳感器無法提供的信息。隨后,可以對該信息做進一步處理和分析。并根據最終應用,必要時還可用傳感器來制定決策。傳感器融合分為兩大類:

●實時傳感器融合——提取并融合傳感器數據,并根據得到的信息實時制定決策。

●離線傳感器融合——這種方案是提取并融合傳感器數據,但在過后的某個時間制定決策。

就嵌入式視覺系統和傳感器融合應用而言,大部分應用適合實時傳感器融合。

嵌入式視覺應用

嵌入式視覺應用正在經歷迅猛增長,涉及領域廣泛,從機器人、高級駕駛員輔助系統(ADAS)到增強現實,不一而足。這些嵌入式視覺應用對最終應用的成功運行有很大幫助。將嵌入式視覺系統提供的信息與來自不同傳感器或多個傳感器的信息進行融合,有助于更好理解環境,從而提升所選應用的性能。

很多嵌入式視覺應用只使用一個圖像傳感器來監控一個方向,例如只監測汽車的前方。利用這樣的圖像傳感器可以檢測、分類和跟蹤對象。然而,由于只使用一個傳感器,因此就無法測量與圖像中對象的距離。也就是說,我們可以檢測和跟蹤到另一個車輛或行人,但如果不借助另一個傳感器,我們就無法確定是否存在碰撞風險。本例中我們需要另一個傳感器,例如RADAR或LIDAR,該傳感器能提供與已檢測到的對象的距離。由于這種方法能夠將來自多個不同類型傳感器的信息融合,因此稱為異構傳感器融合。

ADAS異構傳感器融合實例

另一種方案是提供第二個圖像傳感器,以實現立體視覺。這種方案是讓兩個圖像傳感器朝著相同方向,但分開一小段距離,就像人的兩個眼睛那樣,通過視差確定對象在視場中的深度。像這樣使用多個相同類型的圖像傳感器,稱為同構傳感器融合。

當然,這里需要根據駕駛條件確定架構和傳感器類型的選擇。這包括深度感的范圍、測量精度、環境光和天氣條件、實現成本以及實現復雜程度。

嵌入式視覺不僅可用于對象檢測和汽車防撞,還可以作為導航系統的一部分,用來收集交通標志信息。另外,還可融合醫用X光、MRI和CT等多種不同圖像,或者融合安防與監視設備中的可見光和紅外圖像。

我們通常認為嵌入式視覺應用只使用可見電磁光譜,其實很多嵌入式視覺應用能融合來自可見電磁光譜以外的數據。

處理要求

如果不進行融合,處理圖像時就需要相當大的計算能力,這是因為系統要執行一系列預處理功能。例如在使用彩色圖像傳感器時,這些處理任務包括顏色濾波插值、色彩空間轉換/重采樣以及圖像校正。除此之外,我們還要執行傳感器融合算法本身的處理任務,在之前使用的對象檢測實例中,我們需要執行背景減法、閾值和輪廓檢測,以使用最簡單方案定位對象,或者可能需要更強的 HoG/SVM 分類器。

隨著幀率和圖像尺寸增加,預處理圖像和提取信息所需的處理能力也會隨之增加。

然而,從圖像中提取所需的信息還只是任務的一部分,如果使用異構融合,我們還需對來自第二個傳感器的信息進行配置、驅動、接收和提取。如果我們選擇同構系統,則需要為第二個圖像傳感器再次執行與第一個傳感器相同的圖像處理流水線。

這樣能提供兩組數據,必須對這兩組數據進行處理以確定與對象的實際距離,這才是真正的融合。

All Programmable SoC或FPGA的優勢

在嵌入式視覺系統中,一般使用All Programmable FPGA或All Programmable SoC來實現圖像處理流水線。如果它們能用于傳統嵌入式視覺應用,那么也適用于嵌入式視覺融合應用。

無論選擇FPGA還是SoC,嵌入式視覺應用通常使用處理器進行監視、控制和通信。如果選用All Programmable SoC,那么中間有一個硬核,并有很多支持外設和接口標準。如果使用All Programmable FPGA,就會使用一個軟核,例如 MicroBlazeTM,并采用更加定制化的外設和接口支持。

對于嵌入式視覺傳感器融合應用,我們可進一步利用處理器為所用的眾多傳感器提供簡單接口。例如,加速計、壓力計、陀螺儀和 GPS 傳感器都配有串行外設接口(SPI)和內部集成電路(I2C)接口,都得到All Programmable Zynq?-7000和MicroBlaze軟核處理器的支持。這使軟件能夠快速、方便地從不同類型的傳感器獲得所需信息,并提供給可擴展架構。

在可編程邏輯架構中可輕松實現用于從圖像傳感器提取信息的圖像處理流水線,此外,可編程邏輯架構還可用來為其他異構傳感器(例如 RADAR 和 LIDAR)或者同構系統中的多種情況實現處理流水線。

當使用All Programmable Zynq-7000 或 All Programmable UltraScale+TMMPSoC時,處理器存儲器與可編程邏輯之間緊密耦合的架構允許應用軟件訪問所得到的數據集,以便進一步處理和制定決策。獨立傳感器鏈可在可編程邏輯中實現,而且可并行運行,這對于立體視覺等需要同步操作的情況非常有利。

為了加速在可編程邏輯中實現的融合應用的交付進程,我們可利用高層次綜合(HLS)開發可直接在可編程邏輯架構中實現的算法。

實例架構

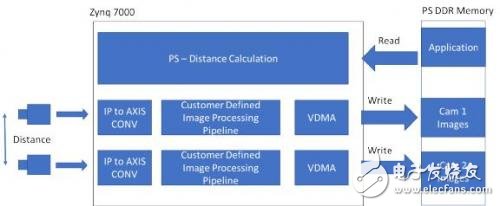

開發前面介紹的對象檢測和距離算法,利用All Programmable SoC演示同構和異構方案。盡管兩種方案使用的傳感器類型不用,但這兩種架構的最終目標都是將兩個數據集放在處理系統的DDR內存,同時將可編程邏輯架構的性能最大化。

實現同構對象檢測系統需要使用相同的傳感器類型,這里是CMOS成像傳感器。這樣做的優勢是只需要開發一條圖像處理鏈,這個圖像處理鏈可以為兩個圖像傳感器在可編程邏輯架構中實例化兩次。

同構架構實現立體視覺系統的條件之一是要求兩個圖像傳感器同步在可編程邏輯架構中并行實現兩個圖像處理鏈并使用具有適當約束的相同時鐘,這樣有助于滿足這一苛刻的要求。

盡管視差計算需要進行密集處理,但兩次實現相同的圖像處理鏈的能力可顯著節省開發成本。

上圖給出了同構方案的架構,其中兩條圖像處理鏈主要基于可用的 IP 模塊。圖像數據采用定制的傳感器接口IP 模塊捕獲,并從并行格式轉換為AXI流媒體。這樣能實現輕松可擴展的圖像處理鏈;我們可以利用高性能 AXI 互連以及視頻DMA將結果從圖像處理鏈傳送到PS DDR。

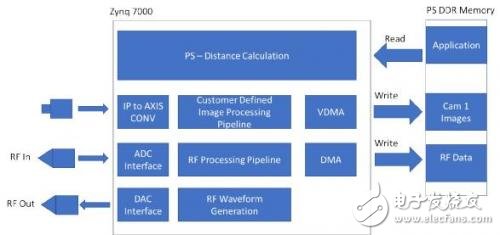

考慮采用不同類型傳感器的異構實例, 我們可將上面介紹的圖像傳感器對象檢測架構與RADAR 距離檢測相結合。對于RADAR的實現,我們有兩個選擇:脈沖方案(多普勒)或者連續波。具體選擇哪種方案取決于最終應用要求,不過,這兩種方法大同小異。

RADAR的架構可分成兩部分:信號生成和信號接收。信號生成部分負責生成連續波信號或者待傳輸的脈沖信號,無論哪種方案都需要利用信號生成 IP 模塊與高速數模轉換器進行接口連接。

信號接收部分也需要使用高速模數轉換器來捕獲接收到的連續波或脈沖信號。說到信號處理,這兩種方案都需要使用通過可編程邏輯架構實現的FFT分析方法;同樣,我們可使用DMA將得到的數據集傳送到PS DDR。

無論選擇哪種實現架構,兩個數據集的融合算法都是通過軟件用PS來執行。另外,這些融合算法對處理帶寬要求較高,實現更高性能的一種方法是使用現有工具集功能,尤其是設計環境 SDSoCTM。

SDSoC可利用Vivado HLS和連接框架(二者對軟件開發人員都是透明的)無縫地在處理器與SoC可編程邏輯之間傳輸軟件功能。當然,我們可利用高層次綜合為同構和異構實現方式的處理鏈開發功能。我們還可進一步擴展,針對所選的實現方案創建定制SDSoC平臺,然后借助SDSoC功能,利用未占用的邏輯資源進一步加速整個嵌入式視覺系統性能的提升。

結論

傳感器融合已經扎根,同時,嵌入式視覺系統正在迅速增長,傳感器快速推廣和普及。All Programmable FPGA 和 SoC 提供的功能使多種類型的傳感器可并行運行并按要求實現同步;同時,利用 SoC 處理系統或軟核處理器來執行數據融合和決策活動。

系統和高層次綜合工具(如 SDSoC 和 Vivado HLS),為工程設計團隊帶來了多種優勢,可確保如期進行應用開發。

電子發燒友App

電子發燒友App

評論