神經(jīng)網(wǎng)絡(luò)是一個(gè)試圖模仿自然生物神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)模式的機(jī)器學(xué)習(xí)框架。 生物神經(jīng)網(wǎng)絡(luò)具有相互連接的神經(jīng)元,神經(jīng)元帶有接受輸入信號(hào)的樹突,然后基于這些輸入,它們通過軸突向另一個(gè)神經(jīng)元產(chǎn)生輸出信號(hào)。 我們

2016-11-07 14:25:12 6041

6041 第三代神經(jīng)網(wǎng)絡(luò),脈沖神經(jīng)網(wǎng)絡(luò)(Spiking Neural Network,SNN),旨在彌合神經(jīng)科學(xué)和機(jī)器學(xué)習(xí)之間的差距,使用最擬合生物神經(jīng)元機(jī)制的模型來進(jìn)行計(jì)算。脈沖神經(jīng)網(wǎng)絡(luò)與目前流行的神經(jīng)網(wǎng)絡(luò)

2018-01-15 10:14:54 15561

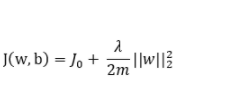

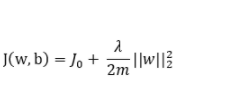

15561 為了訓(xùn)練出高效可用的深層神經(jīng)網(wǎng)絡(luò)模型,在訓(xùn)練時(shí)必須要避免過擬合的現(xiàn)象。過擬合現(xiàn)象的優(yōu)化方法通常有三種。

2020-12-02 14:17:24 2322

2322

處理技術(shù)也可以通過深度學(xué)習(xí)來獲得更優(yōu)異的效果,比如去噪、超分辨率和跟蹤算法等。為了跟上時(shí)代的步伐,必須對(duì)深度學(xué)習(xí)與神經(jīng)網(wǎng)絡(luò)技術(shù)有所學(xué)習(xí)和研究。本文將介紹深度學(xué)習(xí)技術(shù)、神經(jīng)網(wǎng)絡(luò)與卷積神經(jīng)網(wǎng)絡(luò)以及它們?cè)谙嚓P(guān)領(lǐng)域中的應(yīng)用。

2024-01-11 10:51:32 595

595

吳恩達(dá)機(jī)器學(xué)習(xí)筆記之神經(jīng)網(wǎng)絡(luò)參數(shù)的反向傳播算法

2019-05-22 15:11:21

應(yīng)用與其他更簡(jiǎn)單的機(jī)器學(xué)習(xí)應(yīng)用的區(qū)別在于它們采用二維輸入格式。在眾多機(jī)器學(xué)習(xí)應(yīng)用中極為常用的神經(jīng)網(wǎng)絡(luò)是深度神經(jīng)網(wǎng)絡(luò) (DNN)。這類神經(jīng)網(wǎng)絡(luò)擁有多個(gè)隱藏層,能實(shí)現(xiàn)更復(fù)雜的機(jī)器學(xué)習(xí)任務(wù)。...

2021-12-14 07:03:28

經(jīng)典機(jī)器學(xué)習(xí)算法介紹章節(jié)目標(biāo):機(jī)器學(xué)習(xí)是人工智能的重要技術(shù)之一,詳細(xì)了解機(jī)器學(xué)習(xí)的原理、機(jī)制和方法,為學(xué)習(xí)深度學(xué)習(xí)與遷移學(xué)習(xí)打下堅(jiān)實(shí)的基礎(chǔ)。二、深度學(xué)習(xí)簡(jiǎn)介與經(jīng)典網(wǎng)絡(luò)結(jié)構(gòu)介紹神經(jīng)網(wǎng)絡(luò)簡(jiǎn)介神經(jīng)網(wǎng)絡(luò)組件簡(jiǎn)介

2022-04-28 18:56:07

神經(jīng)網(wǎng)絡(luò)Matlab程序

2009-09-15 12:52:24

03_深度學(xué)習(xí)入門_神經(jīng)網(wǎng)絡(luò)和反向傳播算法

2019-09-12 07:08:05

神經(jīng)網(wǎng)絡(luò)基本介紹

2018-01-04 13:41:23

源程序 5.3 Gaussian機(jī) 第6章自組織神經(jīng)網(wǎng)絡(luò) 6.1 競(jìng)爭(zhēng)型學(xué)習(xí) 6.2 自適應(yīng)共振理論(ART)模型 6.3 自組織特征映射(SOM)模型 6.4 CPN模型 第7章 聯(lián)想

2012-03-20 11:32:43

將神經(jīng)網(wǎng)絡(luò)移植到STM32最近在做的一個(gè)項(xiàng)目需要用到網(wǎng)絡(luò)進(jìn)行擬合,并且將擬合得到的結(jié)果用作控制,就在想能不能直接在單片機(jī)上做神經(jīng)網(wǎng)絡(luò)計(jì)算,這樣就可以實(shí)時(shí)計(jì)算,不依賴于上位機(jī)。所以要解決的主要是兩個(gè)

2022-01-11 06:20:53

神經(jīng)網(wǎng)絡(luò)簡(jiǎn)介

2012-08-05 21:01:08

近年來,深度學(xué)習(xí)的繁榮,尤其是神經(jīng)網(wǎng)絡(luò)的發(fā)展,顛覆了傳統(tǒng)機(jī)器學(xué)習(xí)特征工程的時(shí)代,將人工智能的浪潮推到了歷史最高點(diǎn)。然而,盡管各種神經(jīng)網(wǎng)絡(luò)模型層出不窮,但往往模型性能越高,對(duì)超參數(shù)的要求也越來越嚴(yán)格

2019-09-11 11:52:14

的越來越大的挑戰(zhàn)。結(jié)論機(jī)器學(xué)習(xí)神經(jīng)網(wǎng)絡(luò)將沿著一條挑戰(zhàn)高效處理性能的發(fā)展道路繼續(xù)闊步前進(jìn)。先進(jìn)的神經(jīng)網(wǎng)絡(luò)架構(gòu)已經(jīng)顯現(xiàn)出優(yōu)于人類的識(shí)別精確性。用于生成網(wǎng)絡(luò)的最新框架,如 CDNN2,正在推動(dòng)輕型、低功耗嵌入式神經(jīng)網(wǎng)絡(luò)的發(fā)展。這種神經(jīng)網(wǎng)絡(luò)將使目前的高級(jí)輔助駕駛系統(tǒng)具有較高的精確性及實(shí)時(shí)處理能力。`

2017-12-21 17:11:34

基于深度學(xué)習(xí)的神經(jīng)網(wǎng)絡(luò)算法

2019-05-16 17:25:05

神經(jīng)網(wǎng)絡(luò)的發(fā)展可以追溯到二戰(zhàn)時(shí)期,那時(shí)候先輩們正想著如何用人類的方式去存儲(chǔ)和處理信息,于是他們開始構(gòu)建計(jì)算系統(tǒng)。由于當(dāng)時(shí)計(jì)算機(jī)機(jī)器和技術(shù)的發(fā)展限制,這一技術(shù)并沒有得到廣泛的關(guān)注和應(yīng)用。幾十年來

2018-06-05 10:11:50

MATLAB神經(jīng)網(wǎng)絡(luò)

2013-07-08 15:17:13

MATLAB神經(jīng)網(wǎng)絡(luò)工具箱函數(shù)說明:本文檔中所列出的函數(shù)適用于MATLAB5.3以上版本,為了簡(jiǎn)明起見,只列出了函數(shù)名,若需要進(jìn)一步的說明,請(qǐng)參閱MATLAB的幫助文檔。1. 網(wǎng)絡(luò)創(chuàng)建函數(shù)newp

2009-09-22 16:10:08

請(qǐng)問:我在用labview做BP神經(jīng)網(wǎng)絡(luò)實(shí)現(xiàn)故障診斷,在NI官網(wǎng)找到了機(jī)器學(xué)習(xí)工具包(MLT),但是里面沒有關(guān)于這部分VI的幫助文檔,對(duì)于”BP神經(jīng)網(wǎng)絡(luò)分類“這個(gè)范例有很多不懂的地方,比如

2017-02-22 16:08:08

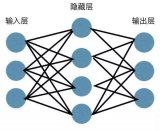

習(xí)神經(jīng)神經(jīng)網(wǎng)絡(luò),對(duì)于神經(jīng)網(wǎng)絡(luò)的實(shí)現(xiàn)是如何一直沒有具體實(shí)現(xiàn)一下:現(xiàn)看到一個(gè)簡(jiǎn)單的神經(jīng)網(wǎng)絡(luò)模型用于訓(xùn)練的輸入數(shù)據(jù):對(duì)應(yīng)的輸出數(shù)據(jù):我們這里設(shè)置:1:節(jié)點(diǎn)個(gè)數(shù)設(shè)置:輸入層、隱層、輸出層的節(jié)點(diǎn)

2021-08-18 07:25:21

`本篇主要介紹:人工神經(jīng)網(wǎng)絡(luò)的起源、簡(jiǎn)單神經(jīng)網(wǎng)絡(luò)模型、更多神經(jīng)網(wǎng)絡(luò)模型、機(jī)器學(xué)習(xí)的步驟:訓(xùn)練與預(yù)測(cè)、訓(xùn)練的兩階段:正向推演與反向傳播、以TensorFlow + Excel表達(dá)訓(xùn)練流程以及AI普及化教育之路。`

2020-11-05 17:48:39

項(xiàng)目名稱:基于PYNQ的神經(jīng)網(wǎng)絡(luò)自動(dòng)駕駛小車試用計(jì)劃:一、本人技術(shù)背景本人有四年以上的嵌入式開發(fā)和三年以上的機(jī)器視覺領(lǐng)域項(xiàng)目實(shí)踐經(jīng)驗(yàn),在計(jì)算機(jī)視覺與FPGA數(shù)字圖像處理方面有較多的理論研究與項(xiàng)目實(shí)踐

2018-12-19 11:36:24

神經(jīng)網(wǎng)絡(luò)首先來看一下維基百科對(duì)神經(jīng)網(wǎng)絡(luò)的定義:人工神經(jīng)網(wǎng)絡(luò)(英語:Artificial Neural Network,ANN),簡(jiǎn)稱神經(jīng)網(wǎng)絡(luò)(Neural Network,NN)或類神經(jīng)網(wǎng)絡(luò),在機(jī)器

2019-03-03 22:10:19

,神經(jīng)網(wǎng)絡(luò)技術(shù)的第三次發(fā)展浪潮仍在繼續(xù),在其背后,高性能CPU、GPU和FPGA、ASIC以強(qiáng)大的算力為技術(shù)的應(yīng)用落地提供了有力的支持。然而目前基于FPGA平臺(tái)搭建神經(jīng)網(wǎng)絡(luò)作為控制器,適合我們自己動(dòng)手實(shí)現(xiàn)

2019-03-02 23:10:52

電子發(fā)燒友總結(jié)了以“神經(jīng)網(wǎng)絡(luò)”為主題的精選干貨,今后每天一個(gè)主題為一期,希望對(duì)各位有所幫助!(點(diǎn)擊標(biāo)題即可進(jìn)入頁面下載相關(guān)資料)人工神經(jīng)網(wǎng)絡(luò)算法的學(xué)習(xí)方法與應(yīng)用實(shí)例(pdf彩版)卷積神經(jīng)網(wǎng)絡(luò)入門資料MATLAB神經(jīng)網(wǎng)絡(luò)30個(gè)案例分析《matlab神經(jīng)網(wǎng)絡(luò)應(yīng)用設(shè)計(jì)》深度學(xué)習(xí)和神經(jīng)網(wǎng)絡(luò)

2019-05-07 19:18:14

今天學(xué)習(xí)了兩個(gè)神經(jīng)網(wǎng)絡(luò),分別是自適應(yīng)諧振(ART)神經(jīng)網(wǎng)絡(luò)與自組織映射(SOM)神經(jīng)網(wǎng)絡(luò)。整體感覺不是很難,只不過一些最基礎(chǔ)的概念容易理解不清。首先ART神經(jīng)網(wǎng)絡(luò)是競(jìng)爭(zhēng)學(xué)習(xí)的一個(gè)代表,競(jìng)爭(zhēng)型學(xué)習(xí)

2019-07-21 04:30:00

}或o koko_{k})的誤差神經(jīng)元偏倚的變化量:ΔΘ ΔΘ Delta Theta=學(xué)習(xí)步長(zhǎng)η ηeta × ×imes 乘以神經(jīng)元的誤差BP神經(jīng)網(wǎng)絡(luò)算法過程網(wǎng)絡(luò)的初始化:包括權(quán)重和偏倚的初始化計(jì)算

2019-07-21 04:00:00

改變系統(tǒng)的線性時(shí)不變特性,類似于卷積神經(jīng)網(wǎng)中的 Pooling 層的作用。論文總結(jié)來自于康納爾大學(xué)的這篇研究論文給出了 一個(gè)利用物理系統(tǒng)實(shí)現(xiàn)深層網(wǎng)絡(luò)學(xué)習(xí)和推理的框架。本文對(duì)于文章舉例的三個(gè)系統(tǒng)不屬于線性

2022-09-26 16:14:55

人工神經(jīng)網(wǎng)絡(luò)是根據(jù)人的認(rèn)識(shí)過程而開發(fā)出的一種算法。假如我們現(xiàn)在只有一些輸入和相應(yīng)的輸出,而對(duì)如何由輸入得到輸出的機(jī)理并不清楚,那么我們可以把輸入與輸出之間的未知過程看成是一個(gè)“網(wǎng)絡(luò)”,通過不斷地給

2008-06-19 14:40:42

人工神經(jīng)網(wǎng)絡(luò)(Artificial Neural Network,ANN)是一種類似生物神經(jīng)網(wǎng)絡(luò)的信息處理結(jié)構(gòu),它的提出是為了解決一些非線性,非平穩(wěn),復(fù)雜的實(shí)際問題。那有哪些辦法能實(shí)現(xiàn)人工神經(jīng)網(wǎng)絡(luò)呢?

2019-08-01 08:06:21

物體所作出的交互反應(yīng),是模擬人工智能的一條重要途徑。人工神經(jīng)網(wǎng)絡(luò)與人腦相似性主要表現(xiàn)在:①神經(jīng)網(wǎng)絡(luò)獲取的知識(shí)是從外界環(huán)境學(xué)習(xí)得來的;②各神經(jīng)元的連接權(quán),即突觸權(quán)值,用于儲(chǔ)存獲取的知識(shí)。神經(jīng)元是神經(jīng)網(wǎng)絡(luò)

2018-10-23 16:16:02

人工神經(jīng)網(wǎng)絡(luò)課件

2016-06-19 10:15:48

機(jī)器學(xué)習(xí)的技術(shù),它是用深度神經(jīng)網(wǎng)絡(luò)來實(shí)現(xiàn)機(jī)器學(xué)習(xí),網(wǎng)絡(luò)深度比原始網(wǎng)絡(luò)加深了數(shù)十甚至上百倍。 增強(qiáng)學(xué)習(xí)也可以達(dá)到機(jī)器學(xué)習(xí)的效果,感興趣的小伙伴可以上網(wǎng)搜索,在此暫時(shí)沒有推薦的書籍。 一個(gè) 34 層

2018-05-11 11:43:14

簡(jiǎn)單理解LSTM神經(jīng)網(wǎng)絡(luò)

2021-01-28 07:16:57

圖卷積神經(jīng)網(wǎng)絡(luò)

2019-08-20 12:05:29

全連接神經(jīng)網(wǎng)絡(luò)和卷積神經(jīng)網(wǎng)絡(luò)的區(qū)別

2019-06-06 14:21:42

機(jī)器學(xué)習(xí)算法篇--卷積神經(jīng)網(wǎng)絡(luò)基礎(chǔ)(Convolutional Neural Network)

2019-02-14 16:37:29

【深度學(xué)習(xí)】卷積神經(jīng)網(wǎng)絡(luò)CNN

2020-06-14 18:55:37

《深度學(xué)習(xí)工程師-吳恩達(dá)》03卷積神經(jīng)網(wǎng)絡(luò)—深度卷積網(wǎng)絡(luò):實(shí)例探究 學(xué)習(xí)總結(jié)

2020-05-22 17:15:57

卷積神經(jīng)網(wǎng)絡(luò)為什么適合圖像處理?

2022-09-08 10:23:10

卷積神經(jīng)網(wǎng)絡(luò)(CNN)究竟是什么,鑒于神經(jīng)網(wǎng)絡(luò)在工程上經(jīng)歷了曲折的歷史,您為什么還會(huì)在意它呢? 對(duì)于這些非常中肯的問題,我們似乎可以給出相對(duì)簡(jiǎn)明的答案。

2019-07-17 07:21:50

卷積神經(jīng)網(wǎng)絡(luò)模型發(fā)展及應(yīng)用轉(zhuǎn)載****地址:http://fcst.ceaj.org/CN/abstract/abstract2521.shtml深度學(xué)習(xí)是機(jī)器學(xué)習(xí)和人工智能研究的最新趨勢(shì),作為一個(gè)

2022-08-02 10:39:39

卷積神經(jīng)網(wǎng)絡(luò)的層級(jí)結(jié)構(gòu) 卷積神經(jīng)網(wǎng)絡(luò)的常用框架

2020-12-29 06:16:44

抽象人工智能 (AI) 的世界正在迅速發(fā)展,人工智能越來越多地支持以前無法實(shí)現(xiàn)或非常難以實(shí)現(xiàn)的應(yīng)用程序。本系列文章解釋了卷積神經(jīng)網(wǎng)絡(luò) (CNN) 及其在 AI 系統(tǒng)中機(jī)器學(xué)習(xí)中的重要性。CNN 是從

2023-02-23 20:11:10

什么是卷積神經(jīng)網(wǎng)絡(luò)?ImageNet-2010網(wǎng)絡(luò)結(jié)構(gòu)是如何構(gòu)成的?有哪些基本參數(shù)?

2021-06-17 11:48:22

和神經(jīng)網(wǎng)絡(luò)包。AIoT那么火,為何大家卻止步于科普文?因?yàn)楝F(xiàn)成的機(jī)器學(xué)習(xí)框架都太復(fù)雜太難用。NNoM從一開始就被設(shè)計(jì)成提供給嵌入式大佬們的一個(gè)簡(jiǎn)單易用的神經(jīng)網(wǎng)絡(luò)框架。你不需要會(huì)TensorFlow

2019-05-01 19:03:01

為提升識(shí)別準(zhǔn)確率,采用改進(jìn)神經(jīng)網(wǎng)絡(luò),通過Mnist數(shù)據(jù)集進(jìn)行訓(xùn)練。整體處理過程分為兩步:圖像預(yù)處理和改進(jìn)神經(jīng)網(wǎng)絡(luò)推理。圖像預(yù)處理主要根據(jù)圖像的特征,將數(shù)據(jù)處理成規(guī)范的格式,而改進(jìn)神經(jīng)網(wǎng)絡(luò)推理主要用于輸出結(jié)果。 整個(gè)過程分為兩個(gè)步驟:圖像預(yù)處理和神經(jīng)網(wǎng)絡(luò)推理。需要提前安裝Tengine框架,

2021-12-23 08:07:33

最近在學(xué)習(xí)電機(jī)的智能控制,上周學(xué)習(xí)了基于單神經(jīng)元的PID控制,這周研究基于BP神經(jīng)網(wǎng)絡(luò)的PID控制。神經(jīng)網(wǎng)絡(luò)具有任意非線性表達(dá)能力,可以通過對(duì)系統(tǒng)性能的學(xué)習(xí)來實(shí)現(xiàn)具有最佳組合的PID控制。利用BP

2021-09-07 07:43:47

FPGA實(shí)現(xiàn)神經(jīng)網(wǎng)絡(luò)關(guān)鍵問題分析基于FPGA的ANN實(shí)現(xiàn)方法基于FPGA的神經(jīng)網(wǎng)絡(luò)的性能評(píng)估及局限性

2021-04-30 06:58:13

,看一下 FPGA 是否適用于解決大規(guī)模機(jī)器學(xué)習(xí)問題。卷積神經(jīng)網(wǎng)絡(luò)是一種深度神經(jīng)網(wǎng)絡(luò) (DNN),工程師最近開始將該技術(shù)用于各種識(shí)別任務(wù)。圖像識(shí)別、語音識(shí)別和自然語言處理是 CNN 比較常見的幾大應(yīng)用。

2019-06-19 07:24:41

本文介紹了如何使用Keras框架,搭建一個(gè)小型的神經(jīng)網(wǎng)絡(luò)-多層感知器,并通過給定數(shù)據(jù)進(jìn)行計(jì)算訓(xùn)練,最好將訓(xùn)練得到的模型提取出參數(shù),放在51單片機(jī)上進(jìn)行運(yùn)行。

2021-11-22 07:00:41

如何用stm32cube.ai簡(jiǎn)化人工神經(jīng)網(wǎng)絡(luò)映射?如何使用stm32cube.ai部署神經(jīng)網(wǎng)絡(luò)?

2021-10-11 08:05:42

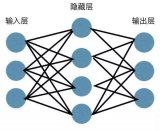

原文鏈接:http://tecdat.cn/?p=5725 神經(jīng)網(wǎng)絡(luò)是一種基于現(xiàn)有數(shù)據(jù)創(chuàng)建預(yù)測(cè)的計(jì)算系統(tǒng)。如何構(gòu)建神經(jīng)網(wǎng)絡(luò)?神經(jīng)網(wǎng)絡(luò)包括:輸入層:根據(jù)現(xiàn)有數(shù)據(jù)獲取輸入的層隱藏層:使用反向傳播優(yōu)化輸入變量權(quán)重的層,以提高模型的預(yù)測(cè)能力輸出層:基于輸入和隱藏層的數(shù)據(jù)輸出預(yù)測(cè)

2021-07-12 08:02:11

人工智能下面有哪些機(jī)器學(xué)習(xí)分支?如何用卷積神經(jīng)網(wǎng)絡(luò)(CNN)方法去解決機(jī)器學(xué)習(xí)監(jiān)督學(xué)習(xí)下面的分類問題?

2021-06-16 08:09:03

稱為BP神經(jīng)網(wǎng)絡(luò)。采用BP神經(jīng)網(wǎng)絡(luò)模型能完成圖像數(shù)據(jù)的壓縮處理。在圖像壓縮中,神經(jīng)網(wǎng)絡(luò)的處理優(yōu)勢(shì)在于:巨量并行性;信息處理和存儲(chǔ)單元結(jié)合在一起;自組織自學(xué)習(xí)功能。與傳統(tǒng)的數(shù)字信號(hào)處理器DSP

2019-08-08 06:11:30

《深度學(xué)習(xí)工程師-吳恩達(dá)》02改善深層神經(jīng)網(wǎng)絡(luò)--超參數(shù)優(yōu)化、batch正則化和程序框架 學(xué)習(xí)總結(jié)

2020-06-16 14:52:01

小女子做基于labview的蒸發(fā)過程中液位的控制,想使用神經(jīng)網(wǎng)絡(luò)pid控制,請(qǐng)問這個(gè)控制方法可以嗎?有誰會(huì)神經(jīng)網(wǎng)絡(luò)pid控制么。。。叩謝

2016-09-23 13:43:16

最簡(jiǎn)單的神經(jīng)網(wǎng)絡(luò)

2019-09-11 11:57:36

脈沖神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)方式有哪幾種?

2021-10-26 06:58:01

解析深度學(xué)習(xí):卷積神經(jīng)網(wǎng)絡(luò)原理與視覺實(shí)踐

2020-06-14 22:21:12

原文鏈接:【嵌入式AI部署&基礎(chǔ)網(wǎng)絡(luò)篇】輕量化神經(jīng)網(wǎng)絡(luò)精述--MobileNet V1-3、ShuffleNet V1-2、NasNet深度神經(jīng)網(wǎng)絡(luò)模型被廣泛應(yīng)用在圖像分類、物體檢測(cè)等機(jī)器

2021-12-14 07:35:25

,而且計(jì)算量較小。利用所提出的片上模型結(jié)構(gòu),即權(quán)重生成和“超級(jí)掩碼”擴(kuò)展相結(jié)合,Hiddenite 芯片大大減少了外部存儲(chǔ)器訪問,提高了計(jì)算效率。深層神經(jīng)網(wǎng)絡(luò)是一種復(fù)雜的人工智能機(jī)器學(xué)習(xí)體系結(jié)構(gòu),需要

2022-03-17 19:15:13

《神經(jīng)網(wǎng)絡(luò)與深度學(xué)習(xí)》講義

2017-07-20 08:58:24 0

0 BP神經(jīng)網(wǎng)絡(luò)模型與學(xué)習(xí)算法

2017-09-08 09:42:48 10

10 使用新的解釋技術(shù),來分析神經(jīng)網(wǎng)絡(luò)做機(jī)器翻譯和語音識(shí)別的訓(xùn)練過程,神經(jīng)網(wǎng)絡(luò)語言處理工作原理有待破解。

2017-12-12 14:31:08 1566

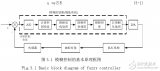

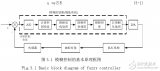

1566 模糊神經(jīng)網(wǎng)絡(luò)就是模糊理論同神經(jīng)網(wǎng)絡(luò)相結(jié)合的產(chǎn)物,它匯集了神經(jīng)網(wǎng)絡(luò)與模糊理論的優(yōu)點(diǎn),集學(xué)習(xí)、聯(lián)想、識(shí)別、信息處理于一體。

2017-12-29 14:40:40 47538

47538

機(jī)器學(xué)習(xí)已經(jīng)在各個(gè)行業(yè)得到了大規(guī)模的廣泛應(yīng)用,并為提升業(yè)務(wù)流程的效率、提高生產(chǎn)率做出了極大的貢獻(xiàn)。這篇文章主要介紹了機(jī)器學(xué)習(xí)中最先進(jìn)的算法之一——神經(jīng)網(wǎng)絡(luò)的八種不同架構(gòu),并從原理和適用范圍進(jìn)行了

2018-01-10 16:30:08 11405

11405

本文簡(jiǎn)述了機(jī)器學(xué)習(xí)核心結(jié)構(gòu)的歷史發(fā)展,并總結(jié)了研究者需要熟知的 8 個(gè)神經(jīng)網(wǎng)絡(luò)架構(gòu)。

2018-02-26 18:40:50 1004

1004 Arm宣布推出神經(jīng)網(wǎng)絡(luò)機(jī)器學(xué)習(xí)(ML) 軟件 Arm NN,這只是第一步,我們還計(jì)劃添加其他高級(jí)神經(jīng)網(wǎng)絡(luò)作為輸入。

2018-03-06 09:26:15 5078

5078 關(guān)鍵詞:神經(jīng)網(wǎng)絡(luò) , CDNN , 深度學(xué)習(xí) 最新CDNN版本具有開放式神經(jīng)網(wǎng)絡(luò)交換(ONNX)支持,開發(fā)人員可以將在各種深度學(xué)習(xí)框架中培訓(xùn)的神經(jīng)網(wǎng)絡(luò)無縫部署在CEVA-XM 視覺DSP

2018-11-01 00:35:02 285

285 本文檔的詳細(xì)介紹的是快速了解神經(jīng)網(wǎng)絡(luò)與深度學(xué)習(xí)的教程資料免費(fèi)下載主要內(nèi)容包括了:機(jī)器學(xué)習(xí)概述,線性模型,前饋神經(jīng)網(wǎng)絡(luò),卷積神經(jīng)網(wǎng)絡(luò),循環(huán)神經(jīng)網(wǎng)絡(luò),網(wǎng)絡(luò)優(yōu)化與正則化,記憶與注意力機(jī)制,無監(jiān)督學(xué)習(xí),概率圖模型,玻爾茲曼機(jī),深度信念網(wǎng)絡(luò),深度生成模型,深度強(qiáng)化學(xué)習(xí)

2019-02-11 08:00:00 25

25 很多同學(xué)入門機(jī)器學(xué)習(xí)之后,直接用TensorFlow調(diào)包實(shí)現(xiàn)神經(jīng)網(wǎng)絡(luò),對(duì)于神經(jīng)網(wǎng)絡(luò)內(nèi)在機(jī)理知之甚少。

2019-05-18 11:02:49 3348

3348

深度學(xué)習(xí)(DL)是機(jī)器學(xué)習(xí)中一種基于對(duì)數(shù)據(jù)進(jìn)行表征學(xué)習(xí)的方法,是一種能夠模擬出人腦的神經(jīng)結(jié)構(gòu)的機(jī)器學(xué)習(xí)方法。深度學(xué)習(xí)的概念源于人工神經(jīng)網(wǎng)絡(luò)的研究。而人工神經(jīng)網(wǎng)絡(luò)ANN(Artificial

2019-09-20 08:00:00 1

1 在人工神經(jīng)網(wǎng)絡(luò)課程之后,有一位同學(xué)課下問了一個(gè)問題,她這學(xué)期也在學(xué)習(xí)機(jī)器學(xué)習(xí)課程,感覺人工神經(jīng)網(wǎng)絡(luò)課程的內(nèi)容與機(jī)器學(xué)習(xí)課程的內(nèi)容大同小異。究竟這些課程之間有何區(qū)別呢?弄不清楚這些自己這學(xué)期的課程很是

2020-11-05 10:02:55 3320

3320 本文檔的主要內(nèi)容詳細(xì)介紹的是神經(jīng)網(wǎng)絡(luò)與神經(jīng)網(wǎng)絡(luò)控制的學(xué)習(xí)課件免費(fèi)下載包括了:1生物神經(jīng)元模型,2人工神經(jīng)元模型,3人工神經(jīng)網(wǎng)絡(luò)模型,4神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)方法

2021-01-20 11:20:05 7

7 卷積神經(jīng)網(wǎng)絡(luò) (Convolutional Neural Network, CNN) 是一種源于人工神經(jīng)網(wǎng)絡(luò)(Neural Network, NN)的深度機(jī)器學(xué)習(xí)方法,近年來在圖像識(shí)別領(lǐng)域取得了巨大

2021-03-25 09:45:21 7

7 深度神經(jīng)網(wǎng)絡(luò)由于結(jié)構(gòu)類似于生物神經(jīng)網(wǎng)絡(luò),因此擁有高效、精準(zhǔn)抽取信息深層隱含特征的能力和能夠學(xué)習(xí)多層的抽

2021-04-26 18:08:40 2087

2087

深度學(xué)習(xí)是推動(dòng)當(dāng)前人工智能大趨勢(shì)的關(guān)鍵技術(shù)。在 MATLAB 中可以實(shí)現(xiàn)深度學(xué)習(xí)的數(shù)據(jù)準(zhǔn)備、網(wǎng)絡(luò)設(shè)計(jì)、訓(xùn)練和部署全流程開發(fā)和應(yīng)用。聯(lián)合高性能 NVIDIA GPU 加快深度神經(jīng)網(wǎng)絡(luò)訓(xùn)練和推斷。

2022-02-18 13:31:44 1714

1714 在介紹卷積神經(jīng)網(wǎng)絡(luò)之前,我們先回顧一下神經(jīng)網(wǎng)絡(luò)的基本知識(shí)。就目前而言,神經(jīng)網(wǎng)絡(luò)是深度學(xué)習(xí)算法的核心,我們所熟知的很多深度學(xué)習(xí)算法的背后其實(shí)都是神經(jīng)網(wǎng)絡(luò)。

2023-02-23 09:14:44 2250

2250 隨著人工智能(AI)技術(shù)的快速發(fā)展,AI可以越來越多地支持以前無法實(shí)現(xiàn)或者難以實(shí)現(xiàn)的應(yīng)用。本文基于此解釋了卷積神經(jīng)網(wǎng)絡(luò)(CNN)及其對(duì)人工智能和機(jī)器學(xué)習(xí)的意義。CNN是一種能夠從復(fù)雜數(shù)據(jù)中提取特征

2023-03-11 23:10:04 523

523 卷積神經(jīng)網(wǎng)絡(luò)原理:卷積神經(jīng)網(wǎng)絡(luò)模型和卷積神經(jīng)網(wǎng)絡(luò)算法 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,CNN)是一種基于深度學(xué)習(xí)的人工神經(jīng)網(wǎng)絡(luò),是深度學(xué)習(xí)技術(shù)的重要應(yīng)用之

2023-08-17 16:30:30 804

804 卷積神經(jīng)網(wǎng)絡(luò)算法是機(jī)器算法嗎? 卷積神經(jīng)網(wǎng)絡(luò)算法是機(jī)器算法的一種,它通常被用于圖像、語音、文本等數(shù)據(jù)的處理和分類。隨著深度學(xué)習(xí)的興起,卷積神經(jīng)網(wǎng)絡(luò)逐漸成為了圖像、語音等領(lǐng)域中最熱門的算法之一。 卷積

2023-08-21 16:49:48 437

437 深度神經(jīng)網(wǎng)絡(luò)是一種基于神經(jīng)網(wǎng)絡(luò)的機(jī)器學(xué)習(xí)算法,其主要特點(diǎn)是由多層神經(jīng)元構(gòu)成,可以根據(jù)數(shù)據(jù)自動(dòng)調(diào)整神經(jīng)元之間的權(quán)重,從而實(shí)現(xiàn)對(duì)大規(guī)模數(shù)據(jù)進(jìn)行預(yù)測(cè)和分類。卷積神經(jīng)網(wǎng)絡(luò)是深度神經(jīng)網(wǎng)絡(luò)的一種,主要應(yīng)用于圖像和視頻處理領(lǐng)域。

2023-08-21 17:07:36 1860

1860 人工神經(jīng)網(wǎng)絡(luò)和bp神經(jīng)網(wǎng)絡(luò)的區(qū)別? 人工神經(jīng)網(wǎng)絡(luò)(Artificial Neural Network, ANN)是一種模仿人腦神經(jīng)元網(wǎng)絡(luò)結(jié)構(gòu)和功能的計(jì)算模型,也被稱為神經(jīng)網(wǎng)絡(luò)(Neural

2023-08-22 16:45:18 2941

2941 神經(jīng)網(wǎng)絡(luò)是深度學(xué)習(xí)算法的基本構(gòu)建模塊。神經(jīng)網(wǎng)絡(luò)是一種機(jī)器學(xué)習(xí)算法,旨在模擬人腦的行為。它由相互連接的節(jié)點(diǎn)組成,也稱為人工神經(jīng)元,這些節(jié)點(diǎn)組織成層次結(jié)構(gòu)。Source:victorzhou.com

2023-09-21 08:30:07 642

642

深度神經(jīng)網(wǎng)絡(luò)是深度學(xué)習(xí)的一種框架,它是一種具備至少一個(gè)隱層的神經(jīng)網(wǎng)絡(luò)。與淺層神經(jīng)網(wǎng)絡(luò)類似

2023-10-11 09:14:33 362

362

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論