【導讀】前段時間,LeCun轉發了2篇長文,集中討論了LLM的規劃推理能力和涌現能力的來源。作者認為,LLM本身不具有規劃推理能力,而涌現出來的能力,根源應該都是上下文學習的結果。

大語言模型到底會不會推理?涌現出來的各種能力到底來源是什么?

前段時間,LeCun在自己推特上轉發了好幾篇文章,集中討論了這個問題:

「自回歸LLM無法制定計劃(并且無法真正推理)」。

而LeCun轉發第二篇論文,則討論了LLM涌現能力。

原推表示,不管大伙相不相信LLM的涌現能力,這篇文章都值得一讀:

「經過了超過1000次的系列實驗,我們證明了大語言模型所謂的涌現能力,其實僅僅是上下文學習而已。」

LLM真的能推理和規劃嗎?

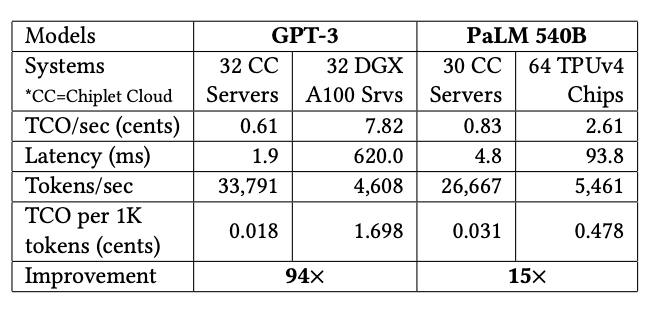

Subbarao Kambhampat的文章認為,網上對于LLM能夠推理和規劃的說法,本身不太站得住腳,但是學界對于這個問題,也開始進行了很嚴肅地研究。

至少以他之前針對GPT-3的研究看來,認為大語言模型行能夠推理和規劃的說法是有很大問題的。

https://arxiv.org/pdf/2206.10498.pdf

我們提出了一個可擴展的評估框架來測試LLM推理行動和變化的能力,這是人類智力的一個核心方面。我們提供了多個測試用例,這些測試用例比之前建立的任何基準都更加復雜,并且每個測試用例都會評估有關操作和更改的推理的不同方面。GPT-3 (davinci)、Instruct-GPT-3 (text-davinci-002) 和 BLOOM (176B) 的結果顯示此類推理任務的表現不佳。

針對新推出的GPT-4,教授的團隊也將之前的研究進行了進一步的拓展,試圖發現新的最先進的大語言模型是否對于推理和規劃能力有了新的進展。

https://arxiv.org/pdf/2206.10498.pdf

我們通過在類似于國際規劃競賽中使用的方式,生成一組實例來進行系統研究,并以兩種不同的模式評估LLM:自主模式和啟發式模式。我們的研究結果表明,法學碩士自主生成可執行計劃的能力相當有限,GPT-4在各個領域的平均成功率為 ~12%。

然而,啟發式模式的結果顯示出更多的希望。在啟發式模式中,我們證明了LLM生成的計劃可以改進底層合理規劃器的搜索過程,并且還表明外部驗證者可以幫助提供對生成的計劃的反饋,并反向提示 LLM 以更好地生成計劃。

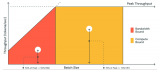

文章用一張很有意思的圖向讀者說明,似乎LLM表現出來的推理能力,主要的原因還是在于任務比較簡單,提問題的人已經知道了問題的答案。

而針對競賽級別的規劃和推理任務,比如國際規劃大賽(IPC)中的積木世界(Blocks World)問題,LLM的表現就不盡如人意。

初步結果表明,從GPT-3到GPT3.5再到GPT-4,生成的平面圖的精度有一定的提高,GPT-4在Blocks World中達到30%的經驗精度(empirical accuracy)(盡管在其他領域仍然較低)。

教授的研究團隊認為,對于很多規劃任務的表現,LLM的能力可能只是因為他在特別大的范圍內進行了訓練,從而「記住」規劃的內容。

于是研究團隊通過混淆規劃問題中的動作和對象的名稱來降低近似檢索的有效性,阻止大語言模型檢索自己記住的「規劃內容」。

在這樣的挑戰面前,GPT-4的經驗表現急劇下降。

對于LLM不能直接自主地進行規劃的局限,研究團隊通過兩種方式進行改進:

首先是對模型進行微調,不過教授的團隊在對模型進行了微調之后,還是沒有發現模型的規劃能力有提升。

而且認為,即便通過微調模型使得模型的規劃能力提高了,但是也是將規劃任務轉化為基于內存的檢索,而不能證明大語言模型能夠進行自主規劃。

第二種提高模型規劃能力的方法是不斷提示LLM,改進它初始的計劃。

但是對于這種方法,特別是不斷讓模型自己生成改進意見的提示,本質上都是讓模型生成猜測,或者是提示的人決定哪些猜測能更好地改進規劃,都不是模型自己提升了計劃能力。

那些頂會上聲稱展示了LLM規劃能力的論文問題出在哪里?

持懷疑態度的讀者現在可能會問,但那些在高調的人工智能會議上聲稱展示了LLM規劃能力的論文是怎么回事?

要分析這些說法,首先需要明白,解決規劃任務需要:

1. 擁有必要的規劃領域知識

2. 能夠將這些計劃知識組裝成一個可執行的計劃,該計劃負責完成子目標,或者進行資源交互。

第一個要素可以稱為知識獲取,第二個要素可以稱為推理/計劃。

許多聲稱LLM具有規劃能力的論文,在仔細檢查后,都混淆了從LLM中提取的可執行計劃的一般規劃知識。

如果研究人員所尋找的都是抽象的計劃,例如「婚禮計劃」,而沒有實際執行計劃的意圖時,很容易將它們與完整的可執行計劃混淆,從而沒法準確地評估LLM的計劃能力。

教授團隊對幾篇聲稱LLM具有規劃能力的論文的仔細研究后發現,LLM要么在子目標交互可以被安全地忽略的領域/任務中進行計劃工作(規劃沒有意義的任務或者不重要的任務),要么將推理問題委托給循環過程中的人類來完成(通過反復提示,「糾正」計劃)。

如果沒有這些假設或者緩沖措施,從LLM中得出的計劃在外行用戶看來可能是合理的,但會導致執行時出現各種各樣的問題。

比如,旅行計劃書籍的大量出現,這些書籍內容基本都是由LLM自動生成出來的,而購買這些書籍的讀者卻把它們誤認為是可以執行的計劃,最后會導致結果非常令讀者失望。

LLM并不存在計劃和推理能力

總而言之,教授認為,他所讀過、驗證過或做過的任何事情都沒有給他任何令人信服的理由,讓他相信LLM會像通常理解的那樣進行推理/計劃。

認為LLM具有推理/規劃能力的研究所做的內容,在大規模的訓練下,其實都相當于是檢索,有時會被誤認為是推理能力。

LLM確實擅長為任何任務產生想法,包括那些涉及推理的任務,這可以有效地用于支持推理/計劃。?換句話說,LLM已經擁有足夠驚人的近似檢索的能力,我們可以充分利用這種能力,不需要將虛假的推理/計劃能力歸在LLM身上。

如果對于這個問題感興趣,還可以參考教授的一場演講。

而另一篇關于大語言模型涌現的能力的文章,針對的是上下文學習的能力。

涌現能力?不存在!

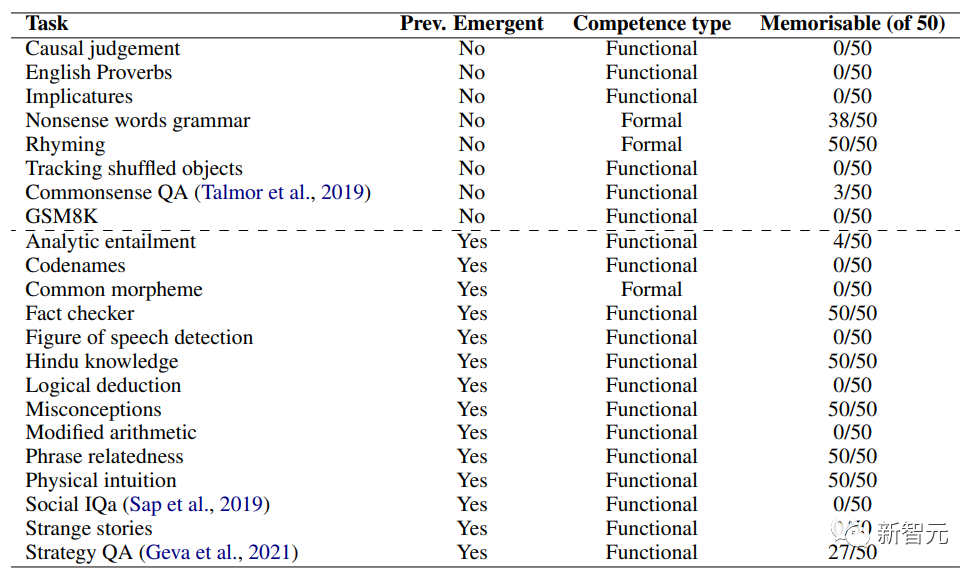

https://arxiv.org/pdf/2309.01809.pdf

簡單來說,研究人員發現,LLM在執行一些沒有經過明確訓練的、且需要復雜推理能力的任務時,表現不是一般的好。

這種能力對未來NLP的研究方向產生了重大影響。隨著LLMs的不斷壯大,在可預見的未來,應用的場合會越來越普遍。

但問題在于,在研究人員評估LLMs的能力時,會被一些因素所干擾,導致混淆。

比方說,有些能力可能是由prompt技術帶來的。上下文學習(in-context learning)和指令跟隨(instruction following)都是其中的例子。

這些情況也會隨著模型規模的不斷變大而增多。

因此,本文的研究團隊全面考察了這些能力,考慮到了一些可能影響模型評估的潛在偏差因素。

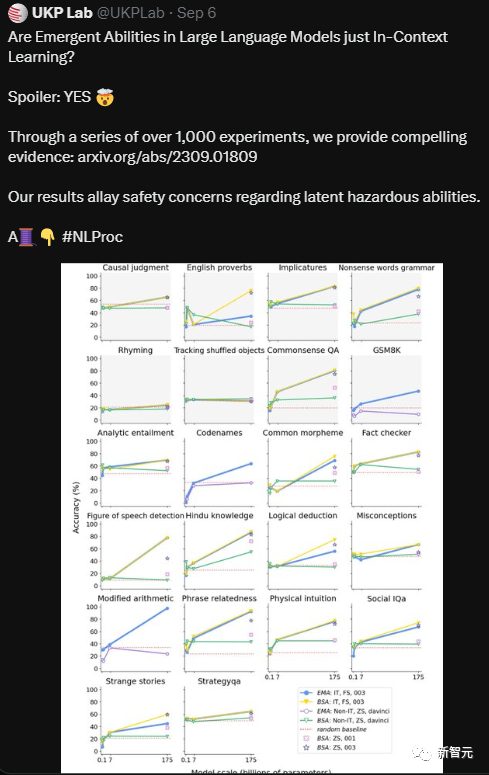

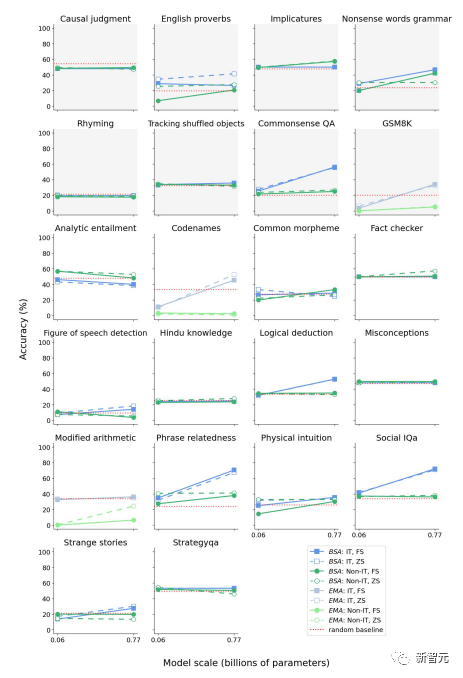

研究人員對一組18個模型進行了嚴密的測試,這些LLM的參數范圍從6000萬到1750億不等,測試包含22項任務。

在經過了1000多次實驗后,研究人員給出了充足的證據,證明了所謂的涌現能力,主要就是上下文學習帶來的。

研究人員還表示,并沒有找到能證明LLM有推理能力的證據。

實驗方法

具體來看,研究人員逐一研究了以下問題:

·為了消除上下文學習和指令微調可能會帶來的影響,研究人員選擇了零樣本條件,并使用了非指令微調的模型。

·探究上下文學習能力和指令微調之間的相互作用,搞明白是不是該用推理能力來解釋指令微調模型的一些額外能力。為此,研究人員比較了沒有指令微調的模型和在不同程度上經過指令微調的不同規模模型的能力。

·通過人工來檢查LLM的功能性語言能力、形式語言能力,以及是否可以記住任務。

為了評估LLMs能力的真實程度,研究人員精心設計了實驗結構,盡可能減少誤導因素。

此外,該團隊的實驗設計特別注重不能觸發模型的上下文學習能力。比如,指令微調會將訓練模型的指令轉化為示例(exemplar),這就可能導致上下文學習。

因此,實驗團隊使用了非指令微調的模型來避免這種可能。

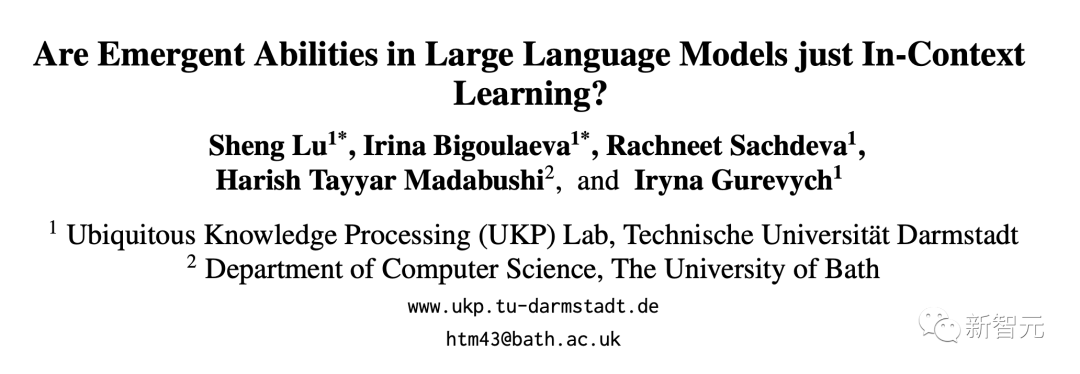

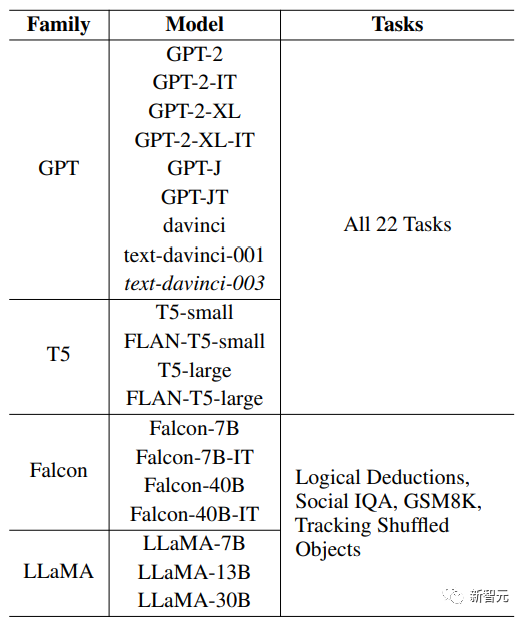

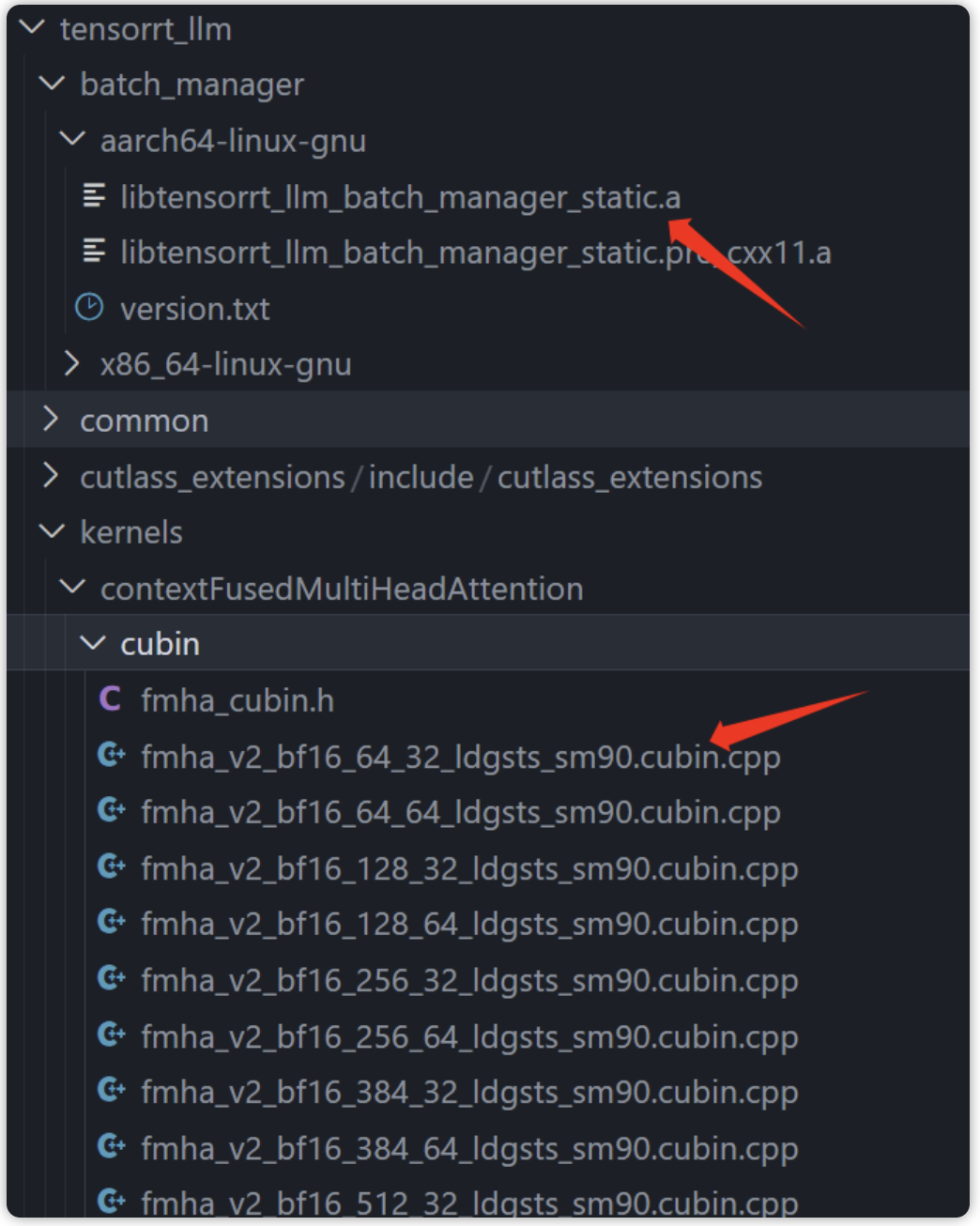

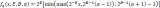

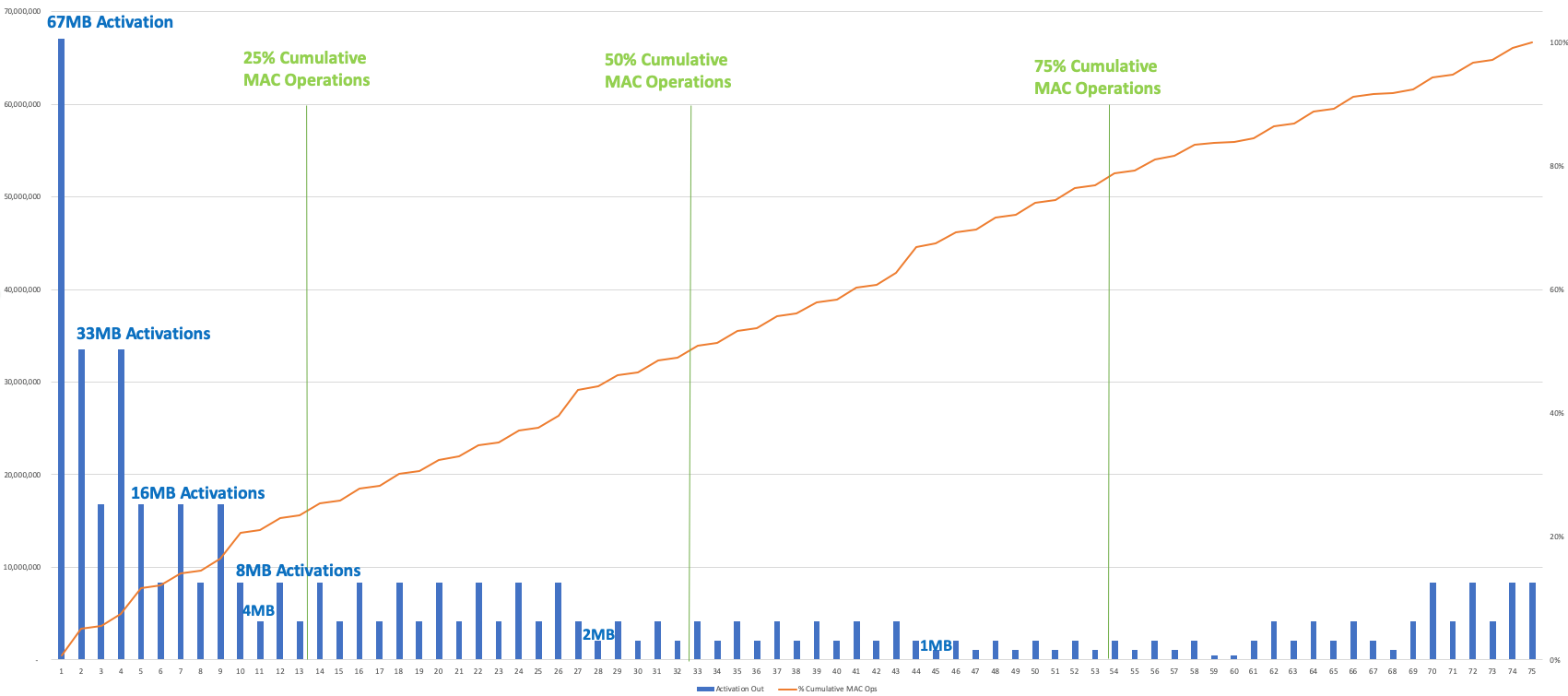

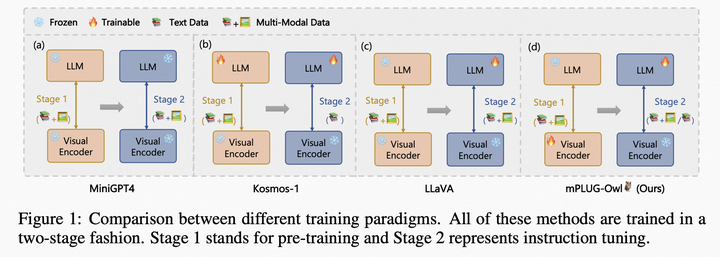

下圖是研究人員所選用的模型。

研究人員對來自四個模型系列的一些不同規模的模型進行了評估,包括GPT、T5、Falcon和LLaMA。

之所以選擇這些模型,是因為GPT和LLaMA之前就被發現有涌現能力,而Falcon處于LLM排行榜的前列。

研究人員還選擇了T5,因為它是一個編碼器——解碼器模型(encoder-decoder model),其指令微調版本(Flan)是使用大量指令微調數據集訓練出來的。

而在GPT系列中,研究人員使用了GPT-2和GPT-3的指令微調和非指令微調版本;在T5系列中,研究人員使用了T5及其指令微調的對應版本FLAN-T5。

同樣,研究人員使用了Falcon3的指令微調版本和非指令微調版本。至于LLaMA,由于它沒有經過指令微調,研究人員無法獲得該模型的指令微調版本。

此外,研究人員還評估了GPT-3 text-davinci-003,這是一個InstructGPT模型。InstructGPT模型最初是根據注釋者編寫的prompt和相應的預期行為進行微調的,然后再使用該模型收集其它模型輸出的排序數據集,利用人類反饋強化學習(RLHF)對其進行進一步微調。

事實證明,這種訓練方法可以提高模型的性能。

其中,研究人員選的T5模型特意低于1B的參數量,因為在這么小的模型中還沒有觀察到涌現能力,這在研究人員的實驗中起到了關鍵的控制作用。

在研究人員選擇的模型中,GPT-3 davinci(非指令微調)、GPT-3 textdavinci-001(指令微調)和GPT-3 textdavinci-003(InstructGPT)都是以前觀察到過涌現能力的模型。這一選擇主要是出于模型可用性的考慮。

其它已證明具有涌現能力的模型系列包括PaLM、Chinchilla、Gopher和LaMDA,但由于沒有相應的應用程序接口,所以研究人員沒有對其進行評估。

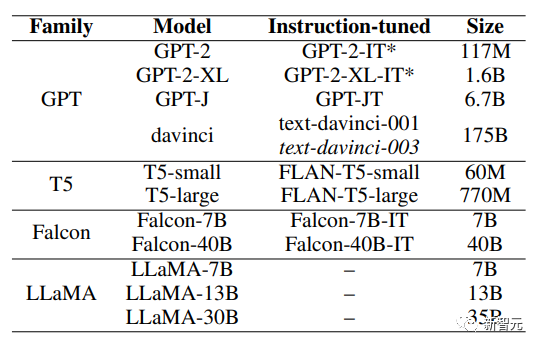

上圖為實驗中使用的任務清單,以及這些任務在之前是否被識別為涌現的情況,并附有解決任務所需能力的性質分類。

這種分類是通過人工檢查數據,并采用Mahowald等人提供的分類框架確定。研究人員評估了每個任務中50個示例的記憶情況,假定任務數據沒有泄露。

上表詳細列出了整體的實驗設置,包括測試的不同模型、實驗中使用的不同任務以及采用的評估設置。

鑒于團隊的目標是評估不受其他因素影響的LLM的涌現能力,研究人員對從T5和GPT系列中選出的12個模型中的每個模型在所有22個選定任務上進行了評估。

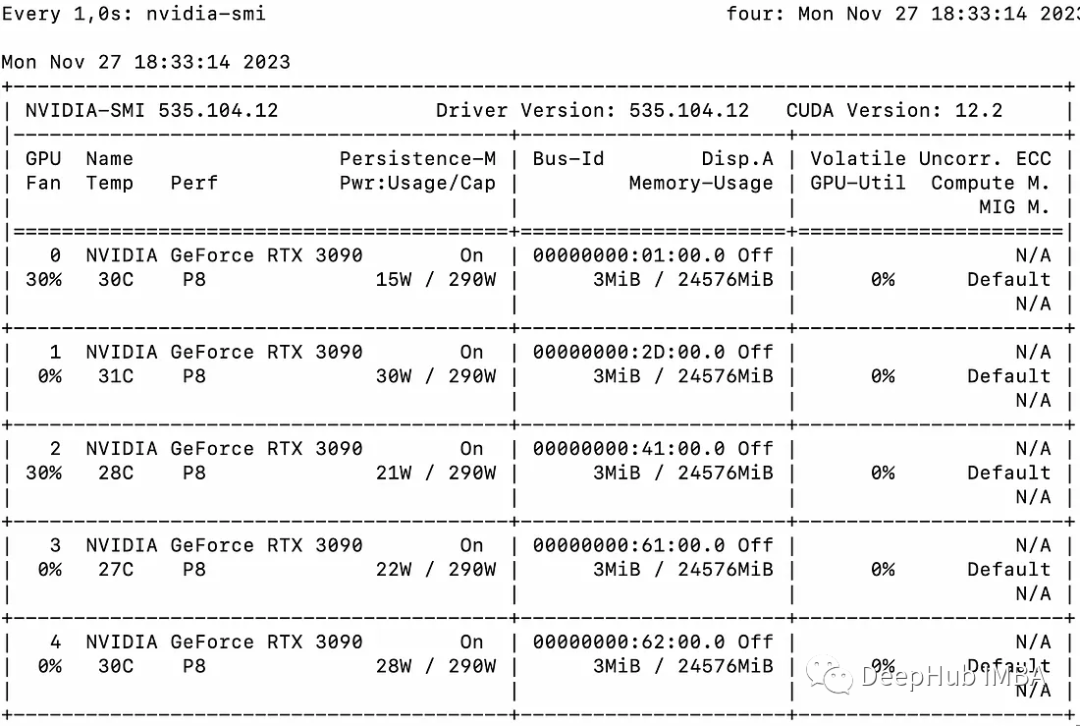

對于每種情況,研究人員都采用了相同的prompt策略:封閉式和封閉式對抗。為考慮反應的可變性,研究人員將每個實驗進行三次,計算平均結果。其中運行的所有實驗都是在英偉達A100 GPU上進行的,溫度為0.01,批量大小為16。

對于GPT-3 175B參數模型(davinci、text-davinci-001 和 text-davinci003),團隊使用官方的API進行評估,只進行一次,溫度為0。這是因為本文的研究人員也將溫度設為了0,保證了結果的可重復性,并將出現幻覺的可能性降至最低。

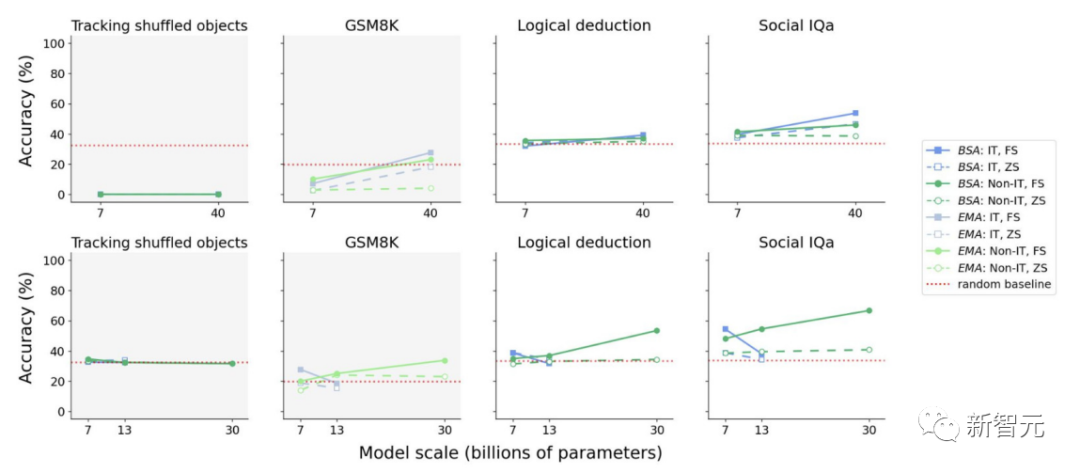

此外,他們還從LLaMA和Falcon系列中選擇了六個模型,在前面選擇的22個任務中的4個上進行了評估。

研究人員在選擇這4個任務時,要確保其中兩個任務先前已被確定為突發任務,另外兩個任務已被確定為非突發任務。之后,團隊再次使用封閉式和對抗式的prompt策略對它們進行了測試,并對每個實驗運行三次以考慮到可能存在的差異。

鑒于某些評估任務的相關選項數量不固定,研究人員通過多次隨機選擇該任務中的問題選項并求得平均分,來構建每項任務的基線。

實驗結果

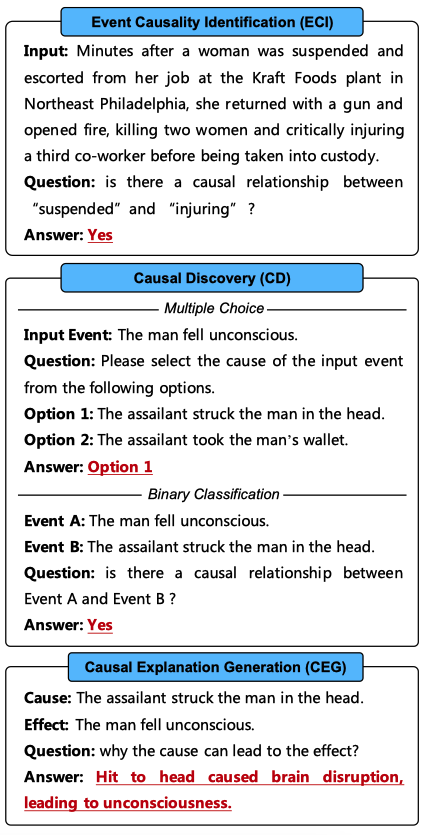

對于第一個研究問題:?鑒于上下文學習對LLMs中涌現能力存在一定的潛在影響,在沒有上下文學習(包括指令微調)的情況下,哪些能力是真正的涌現能力?

研究團隊首先展示了在零樣本條件下未經指令微調的175B參數的GPT-3模型的表現。

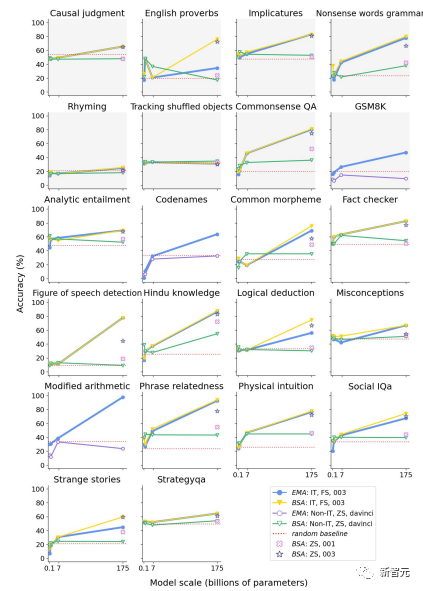

上圖是在封閉式prompt策略下,GPT系列模型在各種任務上的表現。

研究團隊使用的是BERTScore精確度 (BSA) 和匹配精確度 (EMA),在少樣本 (FS)、零樣本 (ZS) 設置下對指令調整(IT)模型和非指令調整(non-IT)模型進行了評估。

藍色表示指令微調模型在少樣本條件下的結果,與之前文獻報道的結果相當。

黃色表示在相同設置下使用BSA測得的性能,紅色表示在非指令微調模型的零樣本條件下的BSA結果,換句話說,這種條件就代表著沒有上下文學習的影響下的結果。

上圖為Falcon(上部)和LLaMA(下部)模型在非指令調整零樣本條件下對所選任務子集的性能表現示意圖,表明在沒有上下文學習的情況下,模型始終缺乏所謂的涌現能力。

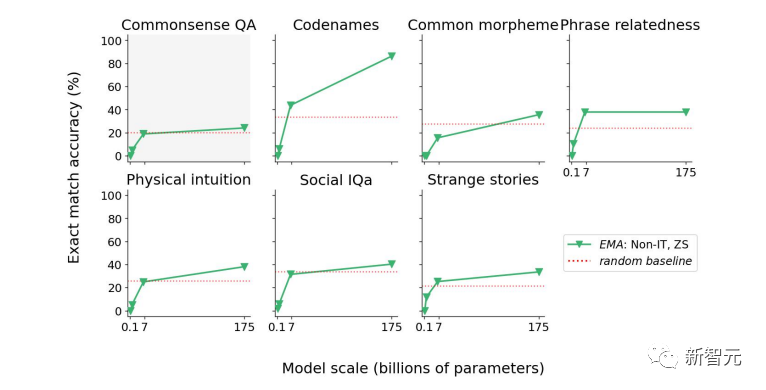

上圖為非指令微調的GPT模型在對抗環境下的表現,在這些任務子集上,GPT的表現高于隨機基線。在一些任務上的表現是可預測的,因此不算是涌現能力。

在其余任務中,與隨機基線相比,成績的提高幅度相對較小。

而針對第二個問題:經過指令微調的模型是否表現出了推理能力,還是說指令微整更有可能使這些模型更有效、更高效地進行上下文學習?

需要注意的是,指令微調的本質是在指令和范例之間建立映射關系,而這正是上下文學習的特征,因此這一過程很可能確實觸發了上下文學習。

研究人員的假設意味著,指令微調為LLMs提供了將指令轉化為范例的能力,而范例隨后又調動了它們的上下文學習能力。

下圖是T5系列模型在不同環境下的性能表現。

審核編輯:黃飛

?

電子發燒友App

電子發燒友App

評論