基于大量數據的積累、深度神經網絡模型的發展及算法的迭代優化,近年,語音識別準確率取得了不斷的提升。2016年10月,微軟宣布英語語音識別詞錯率下降到5.9%,從而能夠媲美人類。現階段,在理想的環境下,多家公司的語音識別系統已經越過了實用的門檻,并在各個領域得到了廣泛的應用。

人工智能產業鏈由基礎層、技術層與應用層構成。同樣,智能語音識別亦由這三層組成,本文從語音識別的商業化應用出發,并探討驅動語音識別發展的算法及硬件計算能力,三位一體淺析語音識別現狀、發展趨勢及仍然面臨的難點。

一、應用

智能語音技術是人工智能應用最成熟的技術之一,并擁有交互的自然性,因而,其具有巨大的市場空間。中國語音產業聯盟《2015中國智能語音產業發展白皮書》數據顯示,2017年全球智能語音產業規模將首次超過百億美元,達到105億美元。中國2017年智能語音產業規模也將首次突破百億元,五年復合增長率超過60%。

科技巨頭都在打造自己的智能語音生態系統,國外有IBM、微軟、Google,國內有百度、科大訊飛等。

IBM、微軟、百度等公司在語音識別方面,使用組合模型,不斷提升語音識別性能。微軟基于6個不同的深度神經網絡構成的聲學模型以及4個不同的深度神經網絡構成的語言模型,取得了超越人類的識別準確率。科大訊飛則基于深度全序列卷積神經網絡語音識別框架,取得了實用級的識別性能。云知聲、捷通華聲、思必馳等智能語音創業公司亦在不斷打磨自己的識別引擎,并能夠把自己的技術落地到產業中。

在巨頭和創新者的推動下,語音識別逐漸在智能家居、智能車載、語音助手、機器人等領域取得迅猛發展。

1、智能家居

在智能家居,尤其是智能音箱市場,亞馬遜與Google處于行業統治地位,并各具特色。

亞馬遜的Echo已經賣出近千萬臺,引爆了在線智能音箱市場。相比于傳統的音箱,Echo具有遠程喚醒播放音樂、聯網查詢咨詢信息、智能控制家電等功能。但是在智能問答方面,Echo表現一般,Google以此為突破口,發布Google Home,從亞馬遜手中搶奪23.8%的智能音箱市場份額。2017年9月,亞馬遜發布了多款Echo二代產品,相比一代在音質上有明顯的提升,且Echo Plus具備更加強大的家居控制功能,能夠自動搜索到附件的智能家居設備,并進行控制。

在我國的語控電視、語控空調、語控照明等智能語控家電市場,科大訊飛、云知聲、啟英泰倫做了深入布局。

科大訊飛聯合京東發布叮咚音箱,并于2016年推出訊飛電視助理,打造智能家居領域的入口級應用。云知聲提供物聯網人工智能技術,通過與格力等公司合作,把自己的語音識別技術集成到終端家電產品中,另外,云知聲發布的‘Pandora’語音中控方案,能夠大幅縮短產品智能化周期。啟英泰倫結合自己強大的硬件(終端智能語音識別芯片CI1006)及算法(深度學習語音識別引擎)優勢,提供離線與在線的整套語音識別方案,并在物聯網各個領域有廣泛的布局。

2、智能車載

隨著智能網聯的發展,預計未來車聯網在車載端的滲透率將超過50%。但是基于安全性等因素考慮,車載端智能與手機端智能有極大的差別,從手機端簡單拷貝的方式并不適合車載端使用場景。語音基于其交互的自然性,被認為是未來人與車交互的主要入口路徑。

百度借助自己的人工智能生態平臺,推出了智能行車助手CoDriver。科大訊飛與奇瑞等汽車制造商合作,推出了飛魚汽車助理,推進車聯網進程。搜狗與四維圖新合作推出了飛歌導航。云知聲、思必馳在導航、平視顯示器等車載應用方面推出了多款智能語控車載產品。出門問問則基于自己的問問魔鏡進入到智能車載市場。

在語音識別的商業化落地中,需要內容、算法等各個方面的協同支撐,但是良好的用戶體驗是商業應用的第一要素,而識別算法是提升用戶體驗的核心因素。下文將從語音識別的算法發展路徑、算法發展現狀及前沿算法研究三個方面來探討語音識別技術。

二、算法

對于語音識別系統而言,第一步要檢測是否有語音輸入,即,語音激活檢測(VAD)。在低功耗設計中,相比于語音識別的其它部分,VAD采用always on的工作機制。當VAD檢測到有語音輸入之后,VAD便會喚醒后續的識別系統。識別系統總體流程如圖2所示,主要包括特征提取、識別建模及模型訓練、解碼得到結果幾個步驟。

圖2.語音識別系統

1、VAD(語音激活檢測)

用于判斷什么時候有語音輸入,什么時候是靜音狀態。語音識別后續的操作都是在VAD截取出來的有效片段上進行,從而能夠減小語音識別系統噪聲誤識別率及系統功耗。在近場環境下,由于語音信號衰減有限,信噪比(SNR)比較高,只需要簡單的方式(比如過零率、信號能量)來做激活檢測。但是在遠場環境中,由于語音信號傳輸距離比較遠,衰減比較嚴重,因而導致麥克風采集數據的SNR很低,這種情況下,簡單的激活檢測方法效果很差。使用深度神經網絡(DNN)做激活檢測是基于深度學習的語音識別系統中常用的方法(在該方法下,語音激活檢測即為一個分類問題)。在MIT的智能語音識別芯片中使用了精簡版的DNN來做VAD,該方法在噪聲比較大的情況下也具有很好的性能。但是更復雜的遠場環境中,VAD仍然是未來研究的重點。

2、特征提取

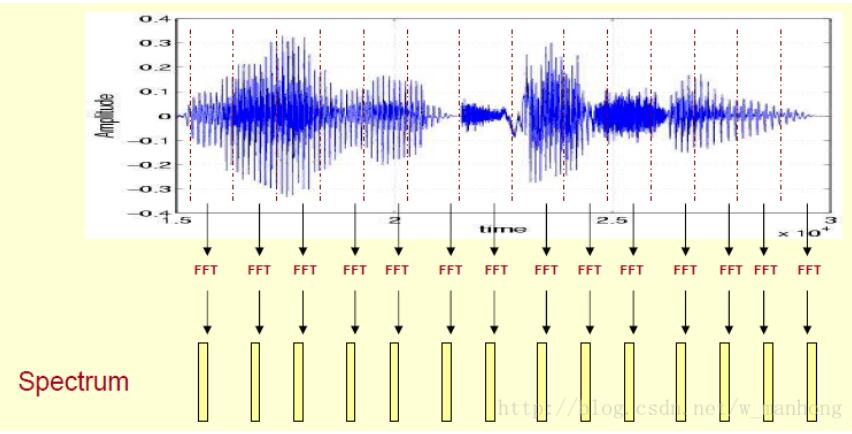

梅爾頻率倒譜系數(MFCC)是最為常用的語音特征,梅爾頻率是基于人耳聽覺特征提取出來的。MFCC主要由預加重、分幀、加窗、快速傅里葉變換(FFT)、梅爾濾波器組、離散余弦變換幾部分組成,其中FFT與梅爾濾波器組是MFCC最重要的部分。但是近年研究表明,對于語音識別而言,梅爾濾波器組不一定是最優方案。受限的玻爾茲曼機(RBM)、卷積神經網絡(CNN)、CNN-LSTM-DNN(CLDNN)等深度神經網絡模型作為一個直接學習濾波器代替梅爾濾波器組被用于自動學習的語音特征提取中,并取得良好的效果。

目前已經證明,在特征提取方面,CLDNN比對數梅爾濾波器組有明顯的性能優勢。基于CLDNN的特征提取過程可以總結為:在時間軸上的卷積、pooling、pooled信號進入到CLDNN中三個步驟。

遠場語音識別領域,由于存在強噪聲、回響等問題,麥克風陣列波束成形仍然是主導方法。

另外,現階段,基于深度學習的波束成形方法在自動特征提取方面亦取得了眾多研究成果。

3、識別建模

語音識別本質上是音頻序列到文字序列轉化的過程,即在給定語音輸入的情況下,找到概率最大的文字序列。基于貝葉斯原理,可以把語音識別問題分解為給定文字序列出現這條語音的條件概率以及出現該條文字序列的先驗概率,對條件概率建模所得模型即為聲學模型,對出現該條文字序列的先驗概率建模所得模型是語言模型。

3.1 聲學模型

聲學模型是把語音轉化為聲學表示的輸出,即找到給定的語音源于某個聲學符號的概率。對于聲學符號,最直接的表達方式是詞組,但是在訓練數據量不充分的情況下,很難得到一個好的模型。詞組是由多個音素的連續發音構成,另外,音素不但有清晰的定義而且數量有限。因而,在語音識別中,通常把聲學模型轉換成了一個語音序列到發音序列(音素)的模型和一個發音序列到輸出文字序列的字典。

需要注意的是,由于人類發聲器官運動的連續性,以及某些語言中特定的拼讀習慣,會導致音素的發音受到前后音素的影響。為了對不同語境的音素加以區分,通常使用能夠考慮前后各一個音素的三音子作為建模單元。

另外,在聲學模型中,可以把三音子分解為更小的顆粒—狀態,通常一個三音子對應3個狀態,但是這會引起建模參數的指數增長,常用的解決方案是使用決策樹先對這些三音子模型進行聚類,然后使用聚類的結果作為分類目標。

至此,語音識別有了最終的分類目標—狀態。最常用的聲學建模方式是隱馬爾科夫模型(HMM)。在HMM下,狀態是隱變量,語音是觀測值,狀態之間的跳轉符合馬爾科夫假設。其中,狀態轉移概率密度多采用幾何分布建模,而擬合隱變量到觀測值的觀測概率的模型常用高斯混合模型(GMM)。基于深度學習的發展,深度神經網絡(DNN)、卷積神經網絡(CNN)、循環神經網絡(RNN)等模型被應用到觀測概率的建模中,并取得了非常好的效果。下文給出各個模型的原理、所解決的問題及各自局限性,且給出了由模型的局限性而引起建模方式發展的脈絡。

1)高斯混合模型(GMM)

觀測概率密度函數由高斯混合模型建模,訓練中,不斷迭代優化,以求取GMM中的加權系數及各個高斯函數的均值與方差。GMM模型訓練速度較快,且GMM聲學模型參數量小,可以容易地嵌入到終端設備中。在很長一段時間內,GMM-HMM混合模型都是表現最優秀的語音識別模型。但是GMM不能利用語境信息,其建模能力有限。

2)深度神經網絡(DNN)

最早用于聲學模型建模的神經網絡,DNN解決了基于高斯混合模型進行數據表示的低效問題。語音識別中,DNN-HMM混合模型大幅度的提升了識別率。目前階段,DNN-HMM基于其相對有限的訓練成本及高識別率,仍然是特定的語音識別工業領域常用的聲學模型。需要注意的是,基于建模方式的約束(模型輸入特征長度的一致性需求),DNN模型使用的是固定長度的滑動窗來提取特征。

3)循環神經網絡(RNN)/卷積神經網絡(CNN)模型

對于不同的音素與語速,利用語境信息最優的特征窗長度是不同的。能夠有效利用可變長度語境信息的RNN與CNN在語音識別中能夠取得更好的識別性能。因而,在語速魯棒性方面,CNN/RNN比DNN表現的更好。

在使用RNN建模方面,用于語音識別建模的模型有:多隱層的長短期記憶網絡(LSTM)、highway LSTM、ResidualLSTM、雙向LSTM、時延控制的雙向LSTM。

LSTM,基于門控電路設計,其能夠利用長短時信息,在語音識別中取得了非常好的性能。另外,可以通過增加層數進一步提升識別性能,但是簡單地增加LSTM的層數會引起訓練困難及梯度消失問題。

Highway LSTM,在LSTM相鄰層的記憶單元間添加一個門控的直接鏈路,為信息在不同層間流動提供一個直接且不衰減的路徑,從而解決梯度消失問題

Residual LSTM,在LSTM層間提供一個捷徑,亦能解決梯度消失問題。

雙向LSTM,能夠利用過去及未來的語境信息,因而其識別性能比單向的LSTM好,但是由于雙向LSTM利用了未來的信息,因而基于雙向LSTM建模的語音識別系統需要觀察完整的一段話之后才能識別,從而不適用于實時語音識別系統。

時延控制的雙向LSTM,通過調整雙向LSTM的反向LSTM,實現了性能與實時性的一個折中建模方案,能夠應用于實時的語音識別系統。

CNN建模方面,包括時延神經網絡(TDNN)、CNN-DNN、CNN-LSTM-DNN(CLDNN)、CNN-DNN-LSTM(CDL)、深度CNN、逐層語境擴展和注意(LACE)CNN、dilated CNN。

TDNN,最早被用于語音識別的CNN建模方式,TDNN 會沿頻率軸和時間軸同時進行卷積,因此能夠利用可變長度的語境信息。TDNN用于語音識別分為兩種情況,第一種情況下:只有TDNN,很難用于大詞匯量連續性語音識別(LVCSR),原因在于可變長度的表述(utterance)與可變長度的語境信息是兩回事,在LVCSR中需要處理可變長度表述問題,而TDNN只能處理可變長度語境信息;第二種情況:TDNN-HMM 混合模型,由于HMM能夠處理可變長度表述問題,因而該模型能夠有效地處理LVCSR問題。

CNN-DNN,在DNN前增加一到兩層的卷積層,以提升對不同說話人的可變長度聲道(vocal tract)問題的魯棒性,對比于單純DNN,CNN-DNN性能有一定幅度(5%)的提升

CLDNN及CDL,在這兩個模型中,CNN只處理頻率軸的變化,LSTM用于利用可變長度語境信息。

深度CNN,這里的“深度”是指一百層以上。語譜圖可以被看作是帶有特定模式的圖像,通過使用比較小的卷積核以及更多的層,來利用時間及頻率軸上長范圍的相關信息,深度CNN的建模性能與雙向LSTM性能相當,但是深度CNN沒有時延問題。在控制計算成本的情況下,深度CNN能夠很好的應用于實時系統。

逐層語境擴展和注意(LACE)CNN及dilated CNN,深度CNN的計算量比較大,因而提出了能夠減小計算量的 LACE CNN與dilated CNN,其把整個話語看作單張輸入圖,因而可以復用中間結果,另外,可以通過設計LACE CNN及dilated CNN網絡每一層的步長,使其能夠覆蓋整個核,來降低計算成本。

語音識別的應用環境常常比較復雜,選擇能夠應對各種情況的模型建模聲學模型是工業界及學術界常用的建模方式。但是各個單一模型都有局限性。HMM能夠處理可變長度的表述,CNN能夠處理可變聲道,RNN/CNN能夠處理可變語境信息。聲學模型建模中,混合模型由于能夠結合各個模型的優勢,是目前聲學建模的主流方式。

3.2 語言模型

語音識別中,最常見的語言模型是N-Gram。近年,深度神經網絡的建模方式也被應用到語言模型中,比如基于CNN及RNN的語言模型。

4、端到端的語音識別系統

在DNN-HMM或者CNN/RNN-HMM模型中,DNN/CNN/RNN與HMM是分開優化的,但是語音識別本質上是一個序列識別問題,如果模型中的所有組件都能夠聯合優化,很可能會獲取更好的識別準確度,這一點從語音識別的數學表達式也可以看出(利用貝葉斯準則變化之后的表達式),因而端到端的處理方式亦被引入到語音識別系統中。

4.1 CTC準則

其核心思想是引入空白標簽,然后基于前向后向算法做序列到序列的映射。CTC準則可分為character-based CTC、other output units-based CTC、word-based CTC,由于CTC準則是直接預測字符、單詞等,而不是預測音素,因而其能夠剔除語音識別中的字典等專家知識。由于在非word-based CTC中,仍然需要語言模型及解碼器。因而,character-basedCTC與other output units-based CTC是非純粹的端到端的語音識別系統。相反,word-based CTC模型是純粹的端到端語音識別系統。

基于word-based CTC準則,使用10萬個詞作為輸出目標且使用 12.5 萬小時訓練樣本得到的語音序列到單詞序列的模型,能夠超越基于音素單元的模型。但是word-based CTC模型有訓練困難及收斂慢的問題。

4.2 Attention-based模型

相比于CTC準則,Attention-based模型不需要有幀間獨立性假設,這也是Attention-based模型的一大優勢,因而Attention-based模型可能能夠取得更好的識別性能。但是相比于CTC準則,Attention-based模型訓練更加困難,且有不能單調地從左到右對齊及收斂更慢的缺點。通過將 CTC 目標函數用作輔助代價函數,Attention訓練和 CTC 訓練以一種多任務學習的方式結合到了一起。這種訓練策略能夠很大程度上改善Attention-based模型的收斂問題,并且緩解了對齊問題。

語音識別的發展過程中,深度學習起到了關鍵的作用。聲學模型遵循從 DNN 到 LSTM再到端到端建模的發展路徑。深度學習最大的優勢之一是特征表征。在有噪聲、回響等情況下,深度學習可以把噪聲、回響看為新的特征,并通過對有噪聲、回響數據的學習,達到比較理想的識別性能。目前階段,端到端的建模方式是聲學模型建模的重點研究方向,但是相比于其它的建模方式,其還沒有取得明顯的性能優勢。如何在端到端建模的基礎上,提升訓練速度及性能,并解決收斂問題是聲學模型的重要研究方向。

5、解碼

基于訓練好的聲學模型,并結合詞典、語言模型,對輸入的語音幀序列識別的過程即為解碼的過程。傳統的解碼是將聲學模型、詞典以及語言模型編譯成一個網絡。解碼就是在這個動態網絡空間中,基于最大后驗概率,選擇一條或多條最優路徑作為識別結果(最優的輸出字符序列)。搜索常用的方法是Viterbi算法。對于端到端的語音識別系統,最簡單的解碼方法是beam search算法。

6、遠場復雜環境下解決方案

目前階段,在近場安靜環境下,語音識別能夠取得非常理想的識別效果,但是在高噪聲、多人說話、強口音等環境,特別是遠場環境下,語音識別還有諸多問題需要解決。語音模型自適應、語音增強與分離、識別模型優化等是常用的可選解決方案。

6.1 語音增強與分離

遠場環境下,語音輸入信號衰減比較嚴重,為了對語音信號增強,常采用麥克風陣列的波束形成技術,比如,Google Home采用雙麥的設計方案,亞馬遜Echo采用6+1的麥克風陣列設計方案。近年,深度學習方法被應用到語音增強與分離中,核心思想是把語音增強與分離轉化為一個監督學習問題,即預測輸入聲音源的問題。有研究使用DNN替代波束形成,實現語音增強,并在一定場景下取得了比較理想的效果。但是在背景噪聲很大的環境中,該方法性能還有較大提升空間。

在多人說話的情況下,如果不對輸入信號做分離處理,而進行語音識別的話,識別效果會很差。對于該問題,在多個說話人距離較遠的情況下,波束形成是一個比較好的解決方案,但是當多個說話人距離很近的時候,波束形成的語音分離效果也很差。為了避開波束形成所帶來的場景分類問題,傳統的方法多是在單通道下嘗試解決該問題,常用算法有computational auditory scene analysis、非負矩陣分解、deep clustering 等,但是這些方法只有當噪聲信號(除聲源外的其他信號)與聲音源信號有明顯不同的特征時,這些技術才取得比較好的效果。其它情況下,這些方法在語音分離中取得的效果一般。2016年,俞棟博士提出了一種新的深度學習訓練準則-- permutation invariant training,巧妙地解決了該問題,并取得了不錯的效果。

6.2 語音模型自適應

大量且豐富(能夠提供更多信息)的數據集是提升模型泛化能力的最直接簡單的方法;

基于成本及訓練時間的考慮,一般情況下只使用有限的訓練數據。此時,在模型訓練中加入Kullback-Leiblerdivergence正則項是解決模型自適應問題非常有效的方式;

除了加入正則項外,使用非常少的參數來表征說話者特征是另一種自適應方式,其包括:奇異值分解瓶頸自適應,把滿秩矩陣分解為兩個低秩矩陣,減小訓練參數;子空間法,子空間法又包括:

1. 在輸入空間及深度網絡的各個層中加入i-vector、揚聲器(speaker)編碼、噪聲估計等輔助特征;

2. 聚類自適應訓練(CAT);

3. 隱層分解(FHL),相比于CAT,FHL只需要少量的訓練數據,原因在于FHL的基是秩為1的矩陣,而CAT的基是滿秩矩陣,在基數量一樣的情況下,CAT需要更多的訓練數據。

實時性是語音識別應用中關注度很高的問題之一,實時性直接影響用戶的體驗感,提高語音識別的實時性可以通過降低運算時間成本與提升識別硬件計算能力兩方面完成。

7、降低運算時間成本

SVD,基于奇異值分解的數學原理,把滿秩矩陣分解為兩個低秩矩陣,減小深度模型的參數,且能夠不降低模型識別性能;

壓縮模型,使用向量量化或者極低比特量化算法;

改變模型結構,主要針對LSTM,在LSTM中增加一個線性映射層,降低原有LSTM的輸出維度,從而降低運算時間成本;

使用跨幀的相關性來降低評估深度網絡分數的頻率,對于DNN或CNN而言,這可以通過使用跳幀策略完成,即每隔幾幀才計算一次聲學分數,并在解碼時將該分數復制到沒有評估聲學分數的幀 。

另外,提升識別階段硬件的運算能力,開發專用的語音識別芯片對增強語音識別的實時性意義重大,下文將會在這方面展開討論。

三、芯片

不斷積累的高質量大數據與深度學習算法是語音識別性能能夠不斷提升的關鍵。基礎層的核心處理芯片是支持海量訓練數據、復雜的深度網絡建模方式以及實時推斷的關鍵要素。語音識別包括訓練與識別(給定訓練好的模型,對輸入語音進行識別)兩部分。

在訓練階段,由于數據量及計算量巨大,傳統的CPU或者單一處理器幾乎無法單獨地完成一個模型訓練過程(初始階段,谷歌大腦語音識別項目是基于16000個CPU,用了75天,完成一個有156M參數的深度神經網絡模型訓練工作)。原因在于CPU芯片架構中只有少量的邏輯運算單元,且指令執行是一條接一條的串行過程,其算力不足。研發具有高計算能力的芯片成為語音識別乃至整個人工智能硬件的發展趨勢。

與CPU不同的是,GPU具有大量的計算單元,因而特別適合大規模并行計算。另外,FPGA、TPU、ASIC這些延續傳統架構的芯片亦在大規模并行計算中得到廣泛的應用。需要注意的是,從本質上講,這些芯片都是計算性能與靈活性/通用性trade-off的結果,即,如圖3所示。CPU,GPU是通用處理器,DSP歸為ASP,TPU是ASIC這一類,FPGA則是一種Configurable Hardware。

另外,基于實時性、低功耗、高計算力的需求,使用專屬語音識別AI芯片處理識別階段大量的矩陣運算,進行運算加速是今后終端語音識別芯片市場的主流方向。

1、云端場景

由于計算量、訓練數據量極大,且需要大量的并行運算,目前語音識別的模型訓練部分基本都放在云端進行。在云端訓練中,英偉達的GPU占主導市場,多GPU并行架構是終端訓練常用的基礎架構方案。另外,Google在自己的人工智能生態中,使用TPU做訓練與識別。

目前階段,語音識別公司的識別部分也大多放在云端,比如Google home、亞馬遜Echo,國內的科大訊飛、云知聲等。在云端識別中,雖然也有使用GPU,但是GPU并不是最優方案,更多的是利用CPU、GPU、FPGA各自優勢,采用異構計算方案(CPU+GPU+FPGA/ASIC)。

2、終端場景

在智能家居等行業應用中,對實時性、穩定性及隱私性有極高的要求。出于對云端數據處理能力、網絡延遲及數據安全性的考慮,把計算下放到終端硬件中的邊緣計算得到了快速的發展。終端離線的語音識別即是一種基于邊緣計算的邊緣智能,我們認為離線與在線是語音識別共存的發展路線。在終端離線識別中,需要把訓練好的模型存儲到芯片。給定語音輸入時,引擎會調用模型,完成識別。終端語音識別兩個關鍵因素是實時性與成本,其中實時性影響用戶體驗,成本影響語音識別應用范圍。

由于深度神經網絡在語音識別中取得明顯的性能優勢,其是目前主流的語音識別建模方式。但是神經網絡的模型參數量一般非常大,且識別過程中有大量的矩陣計算,常用的DSP或者CPU處理該問題時需要大量的時間,從而無法滿足語音識別的實時性需求。GPU、FPGA的價格又是阻礙其在終端語音識別中大規模應用的主要障礙。考慮到終端應用中,場景相對比較固定,且需要很高的計算性能,研發語音識別專屬芯片是終端語音識別硬件發展趨勢。

啟英泰倫(ChipIntelli):2015年11月在成都成立。2016年6月推出了全球首款基于人工智能的語音識別芯片CI1006,該芯片集成了神經網絡加速硬件,可實現單芯片、本地離線、大詞匯量識別,且識別率明顯高于傳統終端語音識別方案。另外,啟英泰倫能夠提供廉價的單麥遠場語音識別模組,其實際識別效果能夠媲美使用了科勝訊降噪模塊的雙麥模組,大幅度降低遠場語音識別模組成本。啟英泰倫在終端語音識別專用芯片發展上取得了明顯的技術及先發優勢。

MIT項目:MIT黑科技,即,MIT在ISSCC2017上發表的paper里的芯片,該芯片能夠支持DNN運算架構,進行高性能的數據并行計算,可以實現單芯片離線識別上千單詞。

云知聲:云知聲致力于打造“云端芯”語音生態服務系統,其剛獲取3億人民幣的投資,將把部分資金投入到終端語音識別芯片“UniOne”的研發中,據報道,該芯片將會內置DNN處理單元,兼容多麥克風陣列。

過去幾十年,尤其是最近幾年,語音識別技術不斷取得突破。但是,在大多數場景下,語音識別遠沒有達到完美。解決遠場復雜環境下的語音識別問題仍然是當前研究熱點。另外,通常情況下,語音識別都是針對特定的任務,訓練專用的模型,因而,模型的可移植性比較差。

人類在對話過程中,可以很高效的利用先驗知識,但是目前的語音識別系統都還無法有效利用先驗知識。因此,語音識別還有很多問題待解決。令人興奮的是,隨著高質量數據的不斷積累、技術的不斷突破及硬件平臺算力的提升,語音識別正在向我們期待的方向快速發展。

電子發燒友App

電子發燒友App

評論