不管是AI也好,其他學科也好,學習、研究的過程中不斷反思學科的歷史,總結學科的發展現狀,找出最重要的理念,總能讓人能“吾道一以貫之”。軟件工程師James Le近期根據他研究的經驗總結出了AI研究必須要知道的十種深度學習方法,非常具有啟發性。

The 10 Deep Learning Methods AI Practitioners Need to?Apply

人們對機器學習的興趣在過去十年經歷了爆炸式的發展。計算機科學項目中、業界會議中、媒體報道中,你都能夠看到機器學習的影子。但是似乎所有關于機器學習的討論中,人們常常會把AI能做什么和他們希望AI能做什么混為一談。

從根本上來講,機器學習其實就是使用算法從原始數據中提取信息,并以某種類型的模型表示出來;然后我們使用這個模型來推斷我們尚未建模的其他數據。

神經網絡作為機器學習的一類模型,它們已經存在了至少50年。神經網絡的基本單元是節點,大致上模仿了哺乳動物大腦中的生物神經元的節點;節點之間的鏈接(也是模仿生物大腦)隨著時間的推移(訓練)而演化。

在上世紀八十年代中期和九十年代早期,許多重要的神經網絡構架都已經做出了,不過要想獲得好的結果還需要足夠強大的計算能力和大體量的數據集,這些當時在當時很不理想,所以也導致人們對機器學習的熱情逐漸冷淡了下來。在21世紀初,計算機的計算能力呈現了指數級的增長——業界見證了計算機技術的“寒武紀大爆發”,這在之前幾乎是不可想象的。深度學習作為這個領域中一個重要的架構,在計算能力爆發式增長的十年中,贏得了許多重要的機器學習競賽。這個紅利的熱度直到今年仍未降溫;今天,我們看到在機器學習的每個角落里都會提到深度學習。

最近,我也開始閱讀一些深度學習方面的學術論文。下面這些是我收集到的幾篇對深度學習領域的發展有重大影響的幾篇論文:

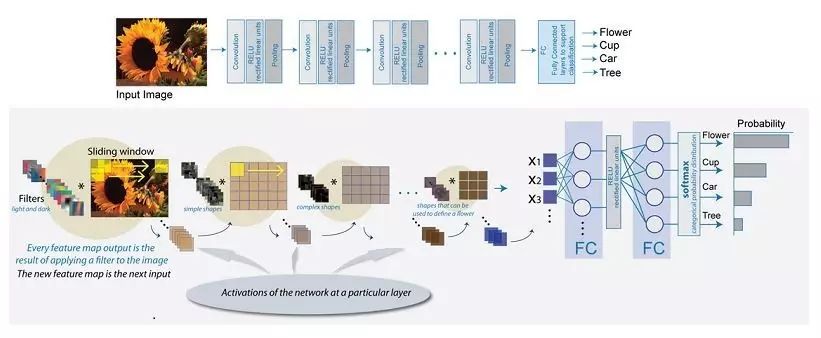

1、Gradient-Based Learning Applied to Document Recognition (1998)

意義:向機器學習世界引進了卷積神經網絡

作者:Yann LeCun, Leon Bottou, Yoshua Bengio, and Patrick Haffner

2、Deep Boltzmann Machines (2009)

意義:為玻爾茲曼機提出了一種新的學習算法,其中包含許多隱藏變量層。

作者:Ruslan Salakhutdinov, Geoffrey Hinton

3、Building High-Level Features Using Large-Scale Unsupervised Learning (2012)

意義:解決了僅從未標記的數據構建高層次、特定類別的特征檢測器的問題。

作者:Quoc V. Le,Marc’Aurelio Ranzato,Rajat Monga,Matthieu Devin,Kai Chen,Greg S. Corrado,Jeff Dean,Andrew Y. Ng

4、DeCAF?—?A Deep Convolutional Activation Feature for Generic Visual Recognition (2013)

意義:釋放了一個深度卷積激活特征的開源實現——DeCAF,以及所有相關的網絡參數,使視覺研究人員能夠深入地在一系列視覺概念學習范例中進行實驗。

作者:Jeff Donahue,Yangqing Jia,Oriol Vinyals,Judy Hoffman,Ning Zhang,Eric Tzeng,Trevor Darrell

5、Playing Atari with Deep Reinforcement Learning (2016)

意義:提供了第一個可以使用強化學習從高維感官輸入中直接學習控制策略的深度學習模型。

作者:

Volodymyr Mnih,Koray Kavukcuoglu,David Silver,Alex Graves,Ioannis Antonoglou,Daan Wierstra,Martin Riedmiller(DeepMind 團隊)

在這些學習和研究中,我發現大量非常有意思的知識點。在這里我將分享十個深度學習的方法,AI工程師可能會將這些應用到他們的機器學習問題當中。

不過,首先先讓我們來定義一下什么是“深度學習”。對很多人來說,給“深度學習”下一個定義確實很有挑戰,因為在過去的十年中,它的形式已經慢慢地發生了很大的變化。

先來在視覺上感受一下“深度學習”的地位。下圖是AI、機器學習和深度學習三個概念的一個關系圖。

電子發燒友App

電子發燒友App

評論