本文來自新智元微信號,本文作為轉載分享。

KDnuggets邀請11位來自工業、學術和技術一線的人員,回顧2018年AI的進展,并展望2019年的關鍵技術趨勢。其中,有觀點認為,2018年AI最大的進展是沒有進展,2019年AutoML、GAN等將繼續成為關鍵技術。

11天,11人,11個展望。

還有11天就要告別2018年,著名數據科學網站KDnuggets邀請國外11位機器學習和AI專家,回顧2018年機器學習和人工智能的主要進展,并對2019年即將出現的關鍵趨勢進行展望。

這11個人中,雖然沒有吳恩達、李飛飛這樣的頂級大咖,但都是身在工業、學術和技術一線的人員,他們包括英偉達機器學習研究主任、Gartner機器學習團隊負責人、華盛頓大學計算機科學與工程系教授等,能夠從不同視角觀察AI的過往和未來。

以下是這11人的觀點:

深度學習“低處的水果都被摘了”

英偉達機器學習研究負責人Anima Anandkumar:

英偉達機器學習研究負責人Anima Anandkuma

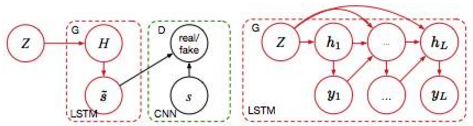

回顧2018年:焦點開始從標準的監督學習轉向更具挑戰性的機器學習問題,像半監督學習、領域自適應、主動學習和生成模型。GAN仍然是非常受歡迎的,研究人員嘗試更困難的任務,如bigGANs和video-to-video合成。開發了替代的生成模型(如神經渲染模型),以在單個網絡中組合生成和預測以幫助半監督學習。

研究人員將深度學習的應用擴展到許多科學領域,如地震預測、材料科學、蛋白質工程、高能物理和控制系統。在這些情況下,領域知識和約束與學習相結合。

預測2019年:“人工智能將模擬和現實聯系起來,變得更安全,更具物理意識”

我們將看到開發新的領域自適應技術,以便將知識從模擬無縫轉移到現實世界。使用模擬將有助于我們克服數據稀缺性并加快新領域和問題的學習。使AI從模擬到實際數據(Sim2real)將對機器人技術、自動駕駛、醫學成像、地震預報等產生重大影響。模擬是解決自動駕駛等安全關鍵應用中所有可能情況的好方法。內置于復雜模擬器中的知識將以新穎的方式被使用,以使AI更具物理意識,更強大,并能夠推廣到新的和看不見的場景。

2019移動設備上的實時語音生成與真人無異

Gartner機器學習團隊負責人Andriy Burkov:

Andriy Burkov

這是我自己作為一名實踐者的看法,不代表Gartner基于研究的官方聲明。以下是我的想法:

回顧2018年:TensorFlow在學術界輸給了PyTorch。有時谷歌的巨大影響力可能會使市場處于次優的方向,因為MapReduce和隨后的hadoop狂熱已經發生了這種情況。

Deepfakes(以及類似的聲音技術)粉碎了最值得信賴的信息來源:視頻。沒有人能敢再說出這樣的話:我看到過那個人說這些話的視頻。幾十年前我們不再相信印刷文字,但直到現在,視頻還是不可動搖。

強化學習以深度學習的形式回歸是非常意外和酷!

Google代替人類致電餐廳并假裝(成功)成為真正的人類系統是一個里程碑。然而,它引發了許多關于道德和人工智能的問題。

個人助理和聊天機器人很快就達到了極限。它們比以往任何時候都好,但不如去年所希望的那么好。

展望2019年:

1)我希望每個人都對今年的AutoML承諾感到興奮。我也期望它失敗(除了一些非常具體和明確定義的案例,如不依靠手工的圖像識別、機器翻譯和文本分類,原始數據接近于機器期望作為輸入,并且數據是豐富的)。

2)營銷自動化:利用成熟的生成對抗網絡和變分自動編碼器,可以生成數千張相同人物或圖像的圖片,這些圖像之間的面部表情或情緒差異很小。根據消費者對這些圖片的反應,我們可以制作出最佳的廣告活動。

3)移動設備上的實時語音生成與真實人類無法區分。

4)自動駕駛的出租車將保持在測試/ PoC階段。

2018年成為對AI過度恐懼的一年

華盛頓大學計算機科學與工程系教授Pedro Domingos:

Pedro Domingos

經歷了多年炒作,2018年成為對AI過度恐懼的一年。

按一些媒體、甚至是一些研究人員的觀點,你會認為特朗普在2016年大選獲勝全拜劍橋分析公司所賜、機器學習算法是充斥偏見和歧視的垃圾、機器人正在取代我們的工作,不久就將霸占我們的生活等等。這些論調不僅僅是說說而已:歐洲和加州已經通過了更加嚴厲的隱私法,聯合國正在就AI武器禁令等內容進行激烈辯論。公眾對AI的觀點越來越暗淡,這種現象即危險又不公平。

希望2019年,人們能夠回歸理性。

數據科學家的角色將傾向于從研究轉向產品開發

牛津大學物聯網課程的首席數據科學家和創始人Ajit Jaokar:

Ajit Jaokar

2018年,一些趨勢開始迅速流行。一個是自動化機器學習,一個是強化學習。這兩個新生趨勢將在2019年進一步發展。作為我在牛津大學開設的物聯網數據科學課程教學內容的一部分,我認為物聯網將越來越多地融入大型生態系統之中,如自動駕駛汽車、機器人和智能城市。

2019年,一種新的機器人技術,即協同機器人(cobots)將成為一個關鍵趨勢。與之前的生產線機器人不同,新的機器人將能夠自主活動,可以理解情感(在我的課程中,我們也在與從事該領域研究的情感研究實驗室合作)。

我的最后一個觀點可能有些爭議:在2019年,數據科學家的角色將傾向于從研究轉向產品開發。我認為人工智能與下一代數據產品的誕生密切相關。數據科學家的作用會發生相應的轉變。

今年開源工具數量增加,所有人都能接觸AI

RE.WORK創始人Nikita Johnson:

Nikita Johnson

我們在2018年親眼目睹的一個變化就是開源工具數量的增加,這些工具降低了AI的技術門檻,使所有人都能更容易地接觸到AI,加強了不同組織機構之間的協作。這些開源社區對于確保AI在社會和企業的所有領域中的傳播至關重要。

同樣,在2019年,我們將看到關注AI的公司數量有所增加,谷歌和微軟最近都啟動了旨在“讓AI造福社會”的項目。隨著全社會對企業提出更高的社會目標的要求,這種將AI技術轉化為對社會積極影響的趨勢,正在獲得越來越多的支持和動力。

2018最大的進展是沒有進展!

CMU機器學習助理教授Zachary Chase Lipton:

我先說說深度學習。深度學習占機器學習和人工智能的公共話語的最大份額。

首先我要提一句,我的觀點可能會惹惱一些人,但我覺得這是2018年的一個合理的解讀:最大的進展是沒有進展!

為什么這么說呢?因為這些進展里面,很大一部分是改進與定性新觀念的本質。

BigGAN是一個GAN,只不過更大。GANS逐漸的增長,產生了真正有趣的結果,在某些意義上的卻是邁出了一大步。

然而,從方法論上來說,它仍然只是GAN,只不過是有了更聰明的課程學習技巧的GAN。

再來說說NLP,今年最重要的故事是ELMO和BERT的情境化嵌入。這些絕對是讓人驚嘆的進步。

但至少Andrew Dai和Quoc Le,從2015年或者2016年就開始預訓練了語言模型,并對下游分類任務進行了微調,只不過當時的規模較小。所以我覺得,今年沒有產生什么“大創意”。

雖然沒有大創意,但今年也有他積極的一面,可能就是我們并沒有將現有技術全部功力發揮出來。硬件、系統和工具的快速發展,可能會帶來二次飛躍。

我認為,現在正在醞釀的很多新想法,都出現在新興的深度學習理論中。很多研究人員,包括Sanjeev Arora,Tengyu Ma,Daniel Soudry,Nati Srebro等等,他們正在做一些非常令人興奮的工作。

很長一段時間,我們有了第一原理理論,這些理論是嚴謹的,但經常忽略了實踐。

然后是太過“學術向”的機器學習,它確實很科學,但卻嵌入打榜中無法自拔。

現在出現了一種新的探究模式,理論與實驗的結合更緊密。你開始看到受實驗啟發的理論論文,進行實驗的理論論文。

最近,我從一個鼓舞人心的經驗中得到一個想法,就是我們可以從理論論文中獲得一個以前從來沒發現過的自然現象。

2019年及以后,我認為應用機器學習會有好的發展,我們正急于進入所有這些聲稱“解決”問題的實際領域。但到目前為止,我們唯一可依賴的只有監督學習。

模式匹配目前還是受限于一些難題。受監督的模型可以找到關聯,但找不出原因。我們不知道哪些信息可以安全依賴,因為它可能會隨著時間的推移而發生變化。這些模型沒有告訴我們干預措施會產生什么樣的影響。

我認為在接下來的一年里,會看到更多機器學習項目被廢棄,或者正是因為黑盒屬性而陷入困境的案例。

我們會看到社區中最有創意的成員,會做出一些改變。不再一味追求打榜,而是更多的關注與填補代表性學習和因果推理之間的鴻溝。

AutoML達到臨界點

KDnuggets的編輯Matthew Mayo:

對我而言,2018年的機器學習是精細的。例如,得益于用于文本分類的通用語言模型微調(ULMFiT)和來自變換器的雙向編碼器表示(BERT)之類的技術,轉移學習有了更廣泛的應用和興趣,特別是在自然語言處理中。

這些并不是過去一年NLP的唯一進步; 另外需要注意的是語言模型嵌入(ELMo),這是一個深層語境化的單詞表示模型,讓模型的每個任務都有相當大的改進。

今年的其他突破似乎集中在對BigGAN等現有技術的改進上。此外,由于眾多倡導型社區成員的聲音,關于機器學習包容性和多樣性的非技術性討論成為主流(NeurIPS就是其中的一個例子)。

我相信,在2019年,研究注意力將從監督學習轉向強化學習和半監督學習等領域,因為這些領域的潛在應用越來越多地得到實現。例如,我們現在處于圖像識別和生成已經到了“解決”地步,并且從中學到的東西可以幫助研究人員追求更復雜的機器應用學習。

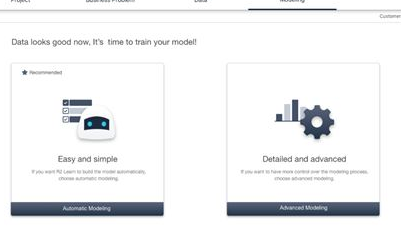

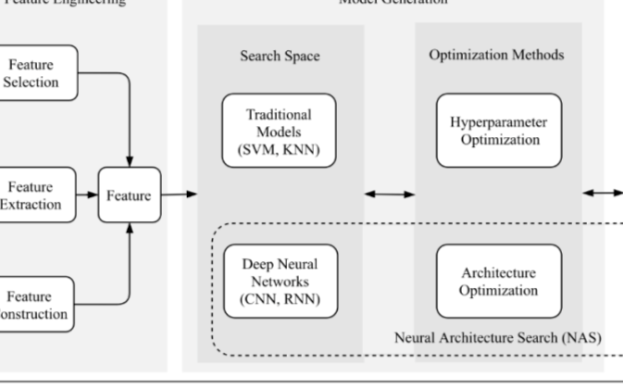

作為業余自動化機器學習(AutoML)傳播者,我認為AutoML將逐步進步,以達到普通的監督學習任務能夠通過可用的方式或尚未完全完善的方法,自信地進行算法選擇和超參數優化。

我認為自動化機器學習的普遍看法將會有轉變(或者已經達到臨界點):從更換開發者到擴張他們。AutoML將不再被視為機器學習工具箱的替代品,而是作為其中包含的另一種工具。相反,我認為,開發者將日常使用這些工具,并且知道如何去操作,這將成為定局。

新的數據科學碩士課程大幅增加

Facebook數據科學家Brandon Rohrer:

2018年的一個重要趨勢是數據科學教育機會的擴散和不斷成熟。在線課程成為原始的數據科學教育場所,這些課程在各個層面都很受歡迎,每年都有更多的學生、發展和新的主題。

在學術界,新的數據科學碩士課程正以每年約十幾個的速度在增加。我們的高校正在響應公司和學生的請求,為數據相關領域提供專門計劃。

另一方面,教程博客文章無處不在。它們為讀者對于數據科學的理解做出了巨大貢獻。

在2019年及以后,數據科學的學術計劃將更普遍地幫助人們學習基礎相關技能,以實現首批數據科學崗位的落地。這是件好事,受認證的機構將填補這方面的長期空缺。

到目前為止,數據科學的資格證書可以在很大程度上證明以前的工作經驗。這會創建一個Catch-22。新數據科學家無法證明自己是否有資格,因為他們從未有過數據科學的工作經驗,而惡性循環的是這些人也無法獲得相關工作,因為他們無法證明自己是否有資格。而教育機構的證書是打破這一循環的重要方式。

但是,在線課程不會隨處可見。因為許多人對大學教育所要求付出的時間和經濟無法作出保證。

現在這些課程已經出現,數據科學教育將始終具有實用的方式。通過對項目工作的相關經驗和在線培訓,即使沒有學位,新的數據科學家也有機會展示他們的技能。在線課程和教程將繼續變得更普遍、更復雜,對數據科學教育也更為重要。

事實上,幾個著名的數據科學和機器學習項目已經把相關課程上傳到網上了,甚至為非預科學生提供入學選擇。我預計數據科學大學學位與在線培訓課程之間的界限將進一步模糊。

三大事件讓2018被銘記

ITV高級數據科學家Elena Sharova:

Elena Sharova

回顧2018年:

我認為,在AI和ML社區中,2018年有三大事件將被銘記。

首先是歐盟全球數據保護條例(GDPR)的啟動,該條例旨在提高個人數據使用的公平性和透明度。該條例使個人有權控制其個人數據和了解個人數據被如何使用,但也引起了對法律解釋的一些混淆。到目前為止,GDPR的最終結果是,許多公司對數據處理做了一些表面上的更改就認為自己是合規的,對忽略了重新設計數據存儲和處理的基礎設施的基本需求。

其次,是“劍橋分析”丑聞,這個事件給整個數據科學界蒙上了一層陰影。如果說之前的辯論主要是關于確保AI和ML產品的公平性,那么這次丑聞引發了更深層次的道德問題。對Facebook在這一事件中的參與程度的最新調查意味著,這些問題不會很快消失。隨著數據科學領域的成熟,這樣的事情還將發生在許多行業,而不僅僅是政治領域。有些案件將更加悲慘,比如亞利桑那州的Uber自動駕駛汽車案,它們將引發強烈的公眾反應。技術就是力量,伴隨著力量而來的是責任。

最后,從更積極的方面來看,Amazon最新的自研服務器處理器芯片意味著,一般人獲取云計算將不再是一個成本問題。

展望2019年:

數據科學家的角色和職責將不僅僅是建立模型來實現準確的預測。

對于ML、AI和數據科學從業者來說,2019年的主要趨勢將是遵循既定的軟件開發實踐的越來越多的責任,尤其是在測試和維護方面。數據科學的最終產品必須與公司技術棧的其余部分共存。有效運行和維護專有軟件的要求將適用于我們構建的模型和解決方案。這意味著最好的軟件開發實踐將支持我們需要遵循的機器學習規則。

遷移學習成功應用到NLP

fast.ai 創始人,舊金山大學副教授Rachel Thomas:

Rachel Thomas

回顧2018年:

遷移學習成功應用到NLP

反烏托邦式的濫用人工智能(包括由仇恨團體和獨裁主義論者進行的監視和操縱)日益受到關注

遷移學習是將預訓練模型應用到一個新的數據集的實踐。遷移學習是計算機視覺領域爆炸式進步的一個關鍵因素,在2018年,遷移學習成功應用到了NLP的工作,包括fast.ai和Sebastian Ruder的ULMFiT,艾倫研究所的ELMo, OpenAI transformer,以及谷歌的BERT。這些進步令人興奮,也令人擔憂。

正在持續的問題,如Facebook在緬甸種族滅絕中扮演的決定性角色,YouTube不成比例地推薦陰謀論(其中許多是促進白人至上注意),以及AI在政府和執法機構監控中的使用,在2018年越來越引起主流媒體的關注。雖然人工智能被濫用是可怕的,但有越來越多的人開始意識到它們,并越來越多地予以反擊,這是件好事。

展望2019年:

我預計這些趨勢將在2019年繼續下去,伴隨著NLP的快速發展(正如Sebastian Ruder所寫的那樣,“NLP的ImageNet時代已經到來”),以及更多的反烏托邦式的發展,包括技術如何被用于監視、煽動暴力和危險政治運動操縱等。

NLP詞嵌入有了兩大重要進展

專門從事搜索、發現和ML/AI的獨立顧問Daniel Tunkelang:

Daniel Tunkelang

回顧2018年:

2018年,自然語言處理和理解的詞嵌入的復雜性方面有了兩大重要進展。

第一次是在三月。艾倫人工智能研究所和華盛頓大學的研究人員發表了Deep contextualized word representations一文,提出了ELMo(Embeddings from Language Models),這是一種開源的深度語境化詞匯表示,改進了word2vec或GloVe這類上下文無關的嵌入。作者通過簡單地替換ELMo預訓練模型中的向量,證明了對現有NLP系統的改進。

第二次是在11月。谷歌開源了BERT(Bidirectional Encoder Representations from Transformers),這是一個雙向的、無監督的語言表示,在維基百科語料上進行了預訓練。正如作者在“BERT:用于語言理解的深層雙向Transformers的預訓練”一文中展示的,他們在各種NLP基準測試中取得了顯著的改進,甚至比ELMo更強。

從智能音箱的迅速普及(到2018年底將達到1億臺左右)到移動電話上數字助理的普及,自然語言理解的進步正迅速從實驗室轉移到現實世界。對于NLP研究和實踐來說,這是一個激動人心的時代。

展望2019年:

但我們還有很長的路要走。

同樣是在今年,艾倫研究所的研究人員發布了《Swag:用于基礎常識推理的大型對抗式數據集》(Swag: A large - large Adversarial Dataset for Grounded Commonsense),這是一個用于需要常識理解的句子完成任務的數據集。他們的實驗表明,最先進的NLP仍然遠遠落后于人類的表現。

但希望我們能在2019年看到更多的NLP突破。計算機科學領域許多最優秀的人才都在從事這方面的工作,工業界也渴望應用他們的成果。

回顧2018年:焦點開始從標準的監督學習轉向更具挑戰性的機器學習問題,像半監督學習、領域自適應、主動學習和生成模型。GAN仍然是非常受歡迎的,研究人員嘗試更困難的任務,如bigGANs和video-to-video合成。開發了替代的生成模型(如神經渲染模型),以在單個網絡中組合生成和預測以幫助半監督學習。

研究人員將深度學習的應用擴展到許多科學領域,如地震預測、材料科學、蛋白質工程、高能物理和控制系統。在這些情況下,領域知識和約束與學習相結合。

預測2019年:“人工智能將模擬和現實聯系起來,變得更安全,更具物理意識”

我們將看到開發新的領域自適應技術,以便將知識從模擬無縫轉移到現實世界。使用模擬將有助于我們克服數據稀缺性并加快新領域和問題的學習。使AI從模擬到實際數據(Sim2real)將對機器人技術、自動駕駛、醫學成像、地震預報等產生重大影響。模擬是解決自動駕駛等安全關鍵應用中所有可能情況的好方法。內置于復雜模擬器中的知識將以新穎的方式被使用,以使AI更具物理意識,更強大,并能夠推廣到新的和看不見的場景。

2019移動設備上的實時語音生成與真人無異

Gartner機器學習團隊負責人Andriy Burkov:

Andriy Burkov

這是我自己作為一名實踐者的看法,不代表Gartner基于研究的官方聲明。以下是我的想法:

回顧2018年:TensorFlow在學術界輸給了PyTorch。有時谷歌的巨大影響力可能會使市場處于次優的方向,因為MapReduce和隨后的hadoop狂熱已經發生了這種情況。

Deepfakes(以及類似的聲音技術)粉碎了最值得信賴的信息來源:視頻。沒有人能敢再說出這樣的話:我看到過那個人說這些話的視頻。幾十年前我們不再相信印刷文字,但直到現在,視頻還是不可動搖。

強化學習以深度學習的形式回歸是非常意外和酷!

Google代替人類致電餐廳并假裝(成功)成為真正的人類系統是一個里程碑。然而,它引發了許多關于道德和人工智能的問題。

個人助理和聊天機器人很快就達到了極限。它們比以往任何時候都好,但不如去年所希望的那么好。

展望2019年:

1)我希望每個人都對今年的AutoML承諾感到興奮。我也期望它失敗(除了一些非常具體和明確定義的案例,如不依靠手工的圖像識別、機器翻譯和文本分類,原始數據接近于機器期望作為輸入,并且數據是豐富的)。

2)營銷自動化:利用成熟的生成對抗網絡和變分自動編碼器,可以生成數千張相同人物或圖像的圖片,這些圖像之間的面部表情或情緒差異很小。根據消費者對這些圖片的反應,我們可以制作出最佳的廣告活動。

3)移動設備上的實時語音生成與真實人類無法區分。

4)自動駕駛的出租車將保持在測試/ PoC階段。

2018年成為對AI過度恐懼的一年

華盛頓大學計算機科學與工程系教授Pedro Domingos:

Pedro Domingos

經歷了多年炒作,2018年成為對AI過度恐懼的一年。

按一些媒體、甚至是一些研究人員的觀點,你會認為特朗普在2016年大選獲勝全拜劍橋分析公司所賜、機器學習算法是充斥偏見和歧視的垃圾、機器人正在取代我們的工作,不久就將霸占我們的生活等等。這些論調不僅僅是說說而已:歐洲和加州已經通過了更加嚴厲的隱私法,聯合國正在就AI武器禁令等內容進行激烈辯論。公眾對AI的觀點越來越暗淡,這種現象即危險又不公平。

希望2019年,人們能夠回歸理性。

數據科學家的角色將傾向于從研究轉向產品開發

牛津大學物聯網課程的首席數據科學家和創始人Ajit Jaokar:

2018年,一些趨勢開始迅速流行。一個是自動化機器學習,一個是強化學習。這兩個新生趨勢將在2019年進一步發展。作為我在牛津大學開設的物聯網數據科學課程教學內容的一部分,我認為物聯網將越來越多地融入大型生態系統之中,如自動駕駛汽車、機器人和智能城市。

2019年,一種新的機器人技術,即協同機器人(cobots)將成為一個關鍵趨勢。與之前的生產線機器人不同,新的機器人將能夠自主活動,可以理解情感(在我的課程中,我們也在與從事該領域研究的情感研究實驗室合作)。

我的最后一個觀點可能有些爭議:在2019年,數據科學家的角色將傾向于從研究轉向產品開發。我認為人工智能與下一代數據產品的誕生密切相關。數據科學家的作用會發生相應的轉變。

今年開源工具數量增加,所有人都能接觸AI

RE.WORK創始人Nikita Johnson:

我們在2018年親眼目睹的一個變化就是開源工具數量的增加,這些工具降低了AI的技術門檻,使所有人都能更容易地接觸到AI,加強了不同組織機構之間的協作。這些開源社區對于確保AI在社會和企業的所有領域中的傳播至關重要。

同樣,在2019年,我們將看到關注AI的公司數量有所增加,谷歌和微軟最近都啟動了旨在“讓AI造福社會”的項目。隨著全社會對企業提出更高的社會目標的要求,這種將AI技術轉化為對社會積極影響的趨勢,正在獲得越來越多的支持和動力。

2018最大的進展是沒有進展!

CMU機器學習助理教授Zachary Chase Lipton:

Zachary Chase Lipton

我先說說深度學習。深度學習占機器學習和人工智能的公共話語的最大份額。

首先我要提一句,我的觀點可能會惹惱一些人,但我覺得這是2018年的一個合理的解讀:最大的進展是沒有進展!

為什么這么說呢?因為這些進展里面,很大一部分是改進與定性新觀念的本質。

BigGAN是一個GAN,只不過更大。GANS逐漸的增長,產生了真正有趣的結果,在某些意義上的卻是邁出了一大步。

然而,從方法論上來說,它仍然只是GAN,只不過是有了更聰明的課程學習技巧的GAN。

再來說說NLP,今年最重要的故事是ELMO和BERT的情境化嵌入。這些絕對是讓人驚嘆的進步。

但至少Andrew Dai和Quoc Le,從2015年或者2016年就開始預訓練了語言模型,并對下游分類任務進行了微調,只不過當時的規模較小。所以我覺得,今年沒有產生什么“大創意”。

雖然沒有大創意,但今年也有他積極的一面,可能就是我們并沒有將現有技術全部功力發揮出來。硬件、系統和工具的快速發展,可能會帶來二次飛躍。

我認為,現在正在醞釀的很多新想法,都出現在新興的深度學習理論中。很多研究人員,包括Sanjeev Arora,Tengyu Ma,Daniel Soudry,Nati Srebro等等,他們正在做一些非常令人興奮的工作。

很長一段時間,我們有了第一原理理論,這些理論是嚴謹的,但經常忽略了實踐。

然后是太過“學術向”的機器學習,它確實很科學,但卻嵌入打榜中無法自拔。

現在出現了一種新的探究模式,理論與實驗的結合更緊密。你開始看到受實驗啟發的理論論文,進行實驗的理論論文。

最近,我從一個鼓舞人心的經驗中得到一個想法,就是我們可以從理論論文中獲得一個以前從來沒發現過的自然現象。

2019年及以后,我認為應用機器學習會有好的發展,我們正急于進入所有這些聲稱“解決”問題的實際領域。但到目前為止,我們唯一可依賴的只有監督學習。

模式匹配目前還是受限于一些難題。受監督的模型可以找到關聯,但找不出原因。我們不知道哪些信息可以安全依賴,因為它可能會隨著時間的推移而發生變化。這些模型沒有告訴我們干預措施會產生什么樣的影響。

我認為在接下來的一年里,會看到更多機器學習項目被廢棄,或者正是因為黑盒屬性而陷入困境的案例。

我們會看到社區中最有創意的成員,會做出一些改變。不再一味追求打榜,而是更多的關注與填補代表性學習和因果推理之間的鴻溝。

AutoML達到臨界點

KDnuggets的編輯Matthew Mayo:

對我而言,2018年的機器學習是精細的。例如,得益于用于文本分類的通用語言模型微調(ULMFiT)和來自變換器的雙向編碼器表示(BERT)之類的技術,轉移學習有了更廣泛的應用和興趣,特別是在自然語言處理中。

這些并不是過去一年NLP的唯一進步; 另外需要注意的是語言模型嵌入(ELMo),這是一個深層語境化的單詞表示模型,讓模型的每個任務都有相當大的改進。

今年的其他突破似乎集中在對BigGAN等現有技術的改進上。此外,由于眾多倡導型社區成員的聲音,關于機器學習包容性和多樣性的非技術性討論成為主流(NeurIPS就是其中的一個例子)。

我相信,在2019年,研究注意力將從監督學習轉向強化學習和半監督學習等領域,因為這些領域的潛在應用越來越多地得到實現。例如,我們現在處于圖像識別和生成已經到了“解決”地步,并且從中學到的東西可以幫助研究人員追求更復雜的機器應用學習。

作為業余自動化機器學習(AutoML)傳播者,我認為AutoML將逐步進步,以達到普通的監督學習任務能夠通過可用的方式或尚未完全完善的方法,自信地進行算法選擇和超參數優化。

我認為自動化機器學習的普遍看法將會有轉變(或者已經達到臨界點):從更換開發者到擴張他們。AutoML將不再被視為機器學習工具箱的替代品,而是作為其中包含的另一種工具。相反,我認為,開發者將日常使用這些工具,并且知道如何去操作,這將成為定局。

新的數據科學碩士課程大幅增加

Facebook數據科學家Brandon Rohrer:

2018年的一個重要趨勢是數據科學教育機會的擴散和不斷成熟。在線課程成為原始的數據科學教育場所,這些課程在各個層面都很受歡迎,每年都有更多的學生、發展和新的主題。

在學術界,新的數據科學碩士課程正以每年約十幾個的速度在增加。我們的高校正在響應公司和學生的請求,為數據相關領域提供專門計劃。

另一方面,教程博客文章無處不在。它們為讀者對于數據科學的理解做出了巨大貢獻。

在2019年及以后,數據科學的學術計劃將更普遍地幫助人們學習基礎相關技能,以實現首批數據科學崗位的落地。這是件好事,受認證的機構將填補這方面的長期空缺。

到目前為止,數據科學的資格證書可以在很大程度上證明以前的工作經驗。這會創建一個Catch-22。新數據科學家無法證明自己是否有資格,因為他們從未有過數據科學的工作經驗,而惡性循環的是這些人也無法獲得相關工作,因為他們無法證明自己是否有資格。而教育機構的證書是打破這一循環的重要方式。

但是,在線課程不會隨處可見。因為許多人對大學教育所要求付出的時間和經濟無法作出保證。

現在這些課程已經出現,數據科學教育將始終具有實用的方式。通過對項目工作的相關經驗和在線培訓,即使沒有學位,新的數據科學家也有機會展示他們的技能。在線課程和教程將繼續變得更普遍、更復雜,對數據科學教育也更為重要。

事實上,幾個著名的數據科學和機器學習項目已經把相關課程上傳到網上了,甚至為非預科學生提供入學選擇。我預計數據科學大學學位與在線培訓課程之間的界限將進一步模糊。

電子發燒友App

電子發燒友App

評論